El auge de los agentes autónomos basados en Inteligencia Artificial (IA) está transformando la forma en que las empresas, los gobiernos y los individuos interactúan con los sistemas tecnológicos.

En medio de este progreso, el debate sobre Gobernanza y ética en los agentes de IA Esto se vuelve esencial para garantizar un uso responsable y seguro, alineado con los valores humanos.

Este artículo explora los fundamentos y las mejores prácticas para crear un ecosistema de IA confiable y transparente.

¿Qué son los agentes de IA y por qué requieren una gobernanza específica?

A diferencia de los modelos estáticos o predictivos, Agentes de IA Tienen la capacidad de observar su entorno, tomar decisiones autónomas y realizar acciones con una intervención humana mínima o nula.

Esta característica crea nuevos desafíos éticos y operativos, ya que implica un alto grado de autonomía, un contexto dinámico y un aprendizaje continuo.

Cuando un agente comete un error, como asignar un diagnóstico incorrecto o realizar una transferencia bancaria indebida, surge la pregunta inevitable: ¿Quién asume la responsabilidad?

La respuesta requiere una estructura de gobernanza de la IA Sólido y multidisciplinario, basado en la rendición de cuentas, la transparencia y la alineación normativa.

Si quieres trabajar de forma profesional y responsable en este ecosistema de IA, obtén más información sobre... Capacitación de agentes y administradores de automatización con IA De NoCode StartUp: una ruta práctica y estratégica para quienes desean liderar de forma ética y eficiente.

Principios fundamentales de ética en agentes inteligentes

El desarrollo de agentes inteligentes debe estar fundamentado en valores como la beneficencia, la justicia, la no maleficencia y la autonomía.

Estos principios están presentes en marcos internacionales como Principios de IA de la OCDE y también en Ley de IA de la UE, legislación pionera de la Unión Europea en materia de clasificación de riesgos y responsabilidades.

El principio de explicabilidad (Inteligencia Artificial Explicable) Es uno de los más importantes. Garantiza que las decisiones tomadas por un agente puedan ser comprendidas, auditadas y justificadas por los humanos.

Esto es fundamental en sectores como la salud, las finanzas y la educación, donde la falta de transparencia puede causar daños irreversibles.

Estrategias para la implementación de una gobernanza eficaz de la IA

Crear una estructura de gobernanza no se limita a documentar directrices. Implica prácticas operativas como la creación de una Comité de ética de la IA, Formación periódica, auditorías técnicas y una definición clara de responsabilidades.

De acuerdo a Mente eléctrica, Es fundamental incorporar procesos iterativos y colaborativos, alineando equipos de las áreas de tecnología, legal, producto y regulación.

Herramientas como Explicabilidad 360 de la IA de IBM y los recursos de Panel de control de IA responsable de Azure Ayudan a controlar el desempeño, los sesgos y la alineación ética.

Para aquellos que deseen profundizar en las herramientas líderes del mercado, Entrenamiento de IA sin código Ofrece un dominio práctico de las tecnologías y los marcos exigidos por las nuevas demandas regulatorias.

Riesgos comunes en entornos con agentes autónomos.

Entre los principales riesgos asociados a los agentes de IA se encuentran... sesgo algorítmico, El falta de supervisión humana y el IA en las sombras — cuando los empleados utilizan herramientas no autorizadas para la automatización.

En los entornos corporativos, estos riesgos pueden comprometer todo, desde el cumplimiento de las normas hasta la obtención de los mismos. LGPD incluso la reputación institucional.

La ausencia de mecanismos de contención y auditoría puede ocasionar pérdidas financieras, filtraciones de datos y decisiones discriminatorias.

Por lo tanto, la gobernanza debe incluir planes de contingencia y actualización continua de los modelos.

Casos de uso reales y mejores prácticas adoptadas.

Empresas como Microsoft y AWS han liderado el camino en las mejores prácticas de gobernanza de la IA, especialmente en sectores de alto impacto.

Microsoft: IA responsable en servicios en la nube

Microsoft implementó su marco de gobernanza de la IA en los servicios de Azure, incluidos los agentes cognitivos utilizados por hospitales e instituciones financieras.

La empresa publica informes de impacto, promoviendo la transparencia y la rendición de cuentas a escala global.

Amazon: Agentes de logística auditables con AWS

La Amazon utiliza agentes de IA. Para automatizar sus centros de distribución globales, la empresa incorporó registros de auditoría y modelos entrenados con principios de equidad algorítmica utilizando los servicios de IA de AWS.

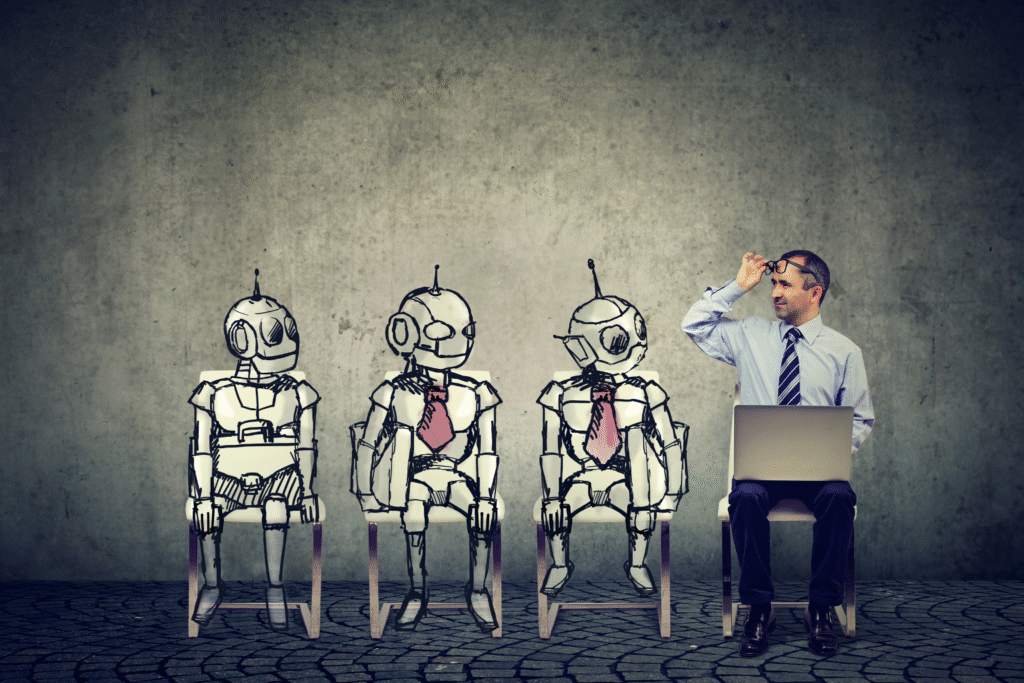

Unilever: IA ética para el análisis de talento

Unilever adoptó Agentes de IA para el análisis automatizado de entrevistas en vídeo durante el proceso de selección.

El sistema se desarrolló con el objetivo de eliminar cualquier sesgo y ha sido sometido a auditorías independientes para garantizar su imparcialidad.

Reino Unido: Gobernanza nacional de la IA con enfoque público

El gobierno británico, a través de Centro para la Ética y la Innovación de Datos (CDEI) creó directrices éticas para los agentes de IA aplicados en servicios públicos, como la asistencia social y la salud.

La iniciativa hace hincapié en la explicabilidad y el seguimiento continuo.

Herramientas y recursos para la gobernanza de agentes de IA

Además de las ya mencionadas, otras herramientas relevantes incluyen:

Estas características permiten desde el seguimiento de los cambios en los modelos hasta la generación de informes para auditoría y cumplimiento normativo, lo que ayuda a aumentar la fiabilidad del ecosistema de IA.

Tendencias futuras y legislación emergente

El futuro de la gobernanza y la ética en los agentes de IA depende de la integración con regulaciones como la Ley de IA y la creación de sistemas de alineación automática entre los valores humanos y los objetivos de los agentes.

Los investigadores de Arion Research destacan el surgimiento de modelos de Responsabilidad distribuida, en el que múltiples actores asumen responsabilidades distintas dentro del ciclo de vida del agente.

La aplicación de técnicas de explicabilidad y equidad, combinada con pruebas de robustez, será cada vez más necesaria en sectores como la defensa, la salud y la educación.

La tendencia actual es que los organismos reguladores exijan informes periódicos sobre el desempeño ético y el impacto social.

Caminos hacia un ecosistema de IA confiable y humano

Construir un ecosistema basado en Gobernanza y ética en los agentes de IA Se requiere más que tecnologías sofisticadas: se exige compromiso institucional, formación continua y normativas inteligentes.

Las organizaciones que progresan gracias a estructuras sólidas, herramientas de monitoreo y una cultura de responsabilidad tienen más probabilidades de innovar de forma segura.

Si desea prepararse profesionalmente para aplicar estratégicamente la gobernanza, la ética y la automatización de la IA, acceda al [enlace/recurso]. Capacitación de agentes y administradores de automatización con IA y aprender en la práctica cómo liderar proyectos con responsabilidad y conocimientos técnicos.