La tecnología de codificación de IA, también conocida como Código de IA o Codificación Vibe, está cambiando la forma en que programamos y desarrollamos software. Además, este nuevo enfoque utiliza inteligencia artificial para simplificar el proceso de codificación. Pero ¿cómo sucede esto?

En este contenido comprenderás qué es la codificación de IA y las posibilidades que ofrece.

Descubra también las mejores herramientas de Vibe Coding disponibles. Te permitirán comenzar a explorar esta innovación y crear tus propias soluciones con facilidad. ¡Feliz lectura!

¿Qué es Vibe Coding?

La codificación IA, o codificación Vibe, transforma el desarrollo de software. Permite a personas sin habilidades avanzadas crear aplicaciones, sitios web o automatizaciones utilizando solo descripciones simples en lenguaje natural.

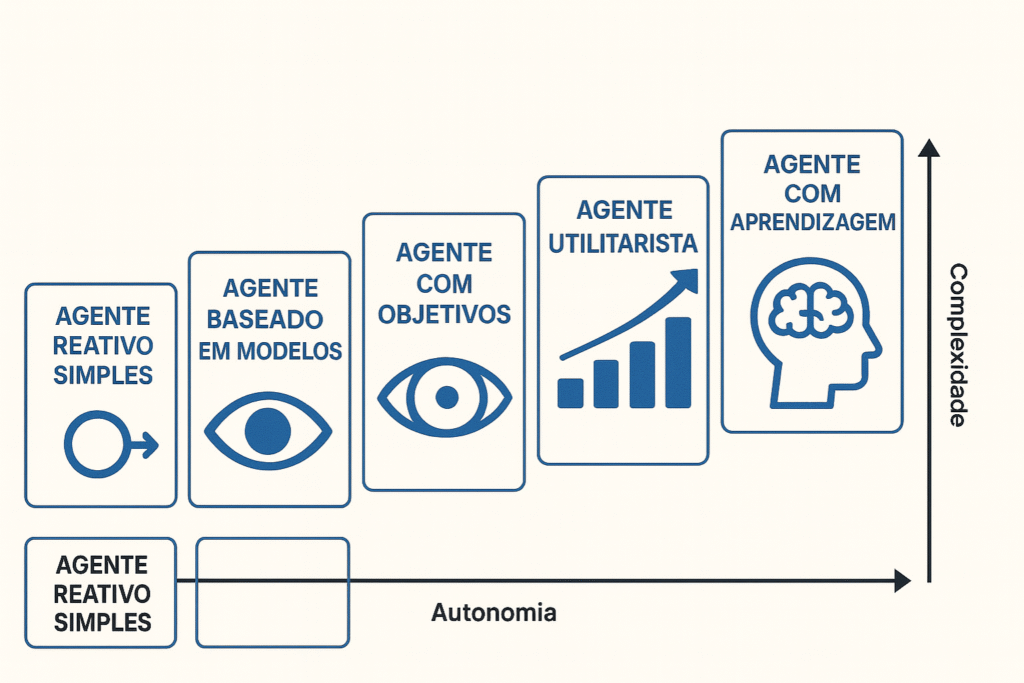

El término “Vibe Coding” fue acuñado por Andrej Karpathy, uno de los fundadores de OpenAI. Se refiere al proceso de utilizar modelos de lenguaje grandes, como los de la IA generativa, para generar código de aplicación de forma casi autónoma. Esto sucede a partir de comandos o descripciones simples.

La idea central de la automatización es que el programador simplemente “describe la vibra” de lo que quiere, y la IA traduce esa intención en código funcional. En otras palabras, Vibe Coding ofrece una forma más intuitiva de desarrollar aplicaciones.

Para ello, utiliza modelos MVVM (Modelo-Vista-Vista-Modelo), que facilitan la interacción con la inteligencia artificial. Como resultado, es posible generar y adaptar el código según las necesidades del usuario.

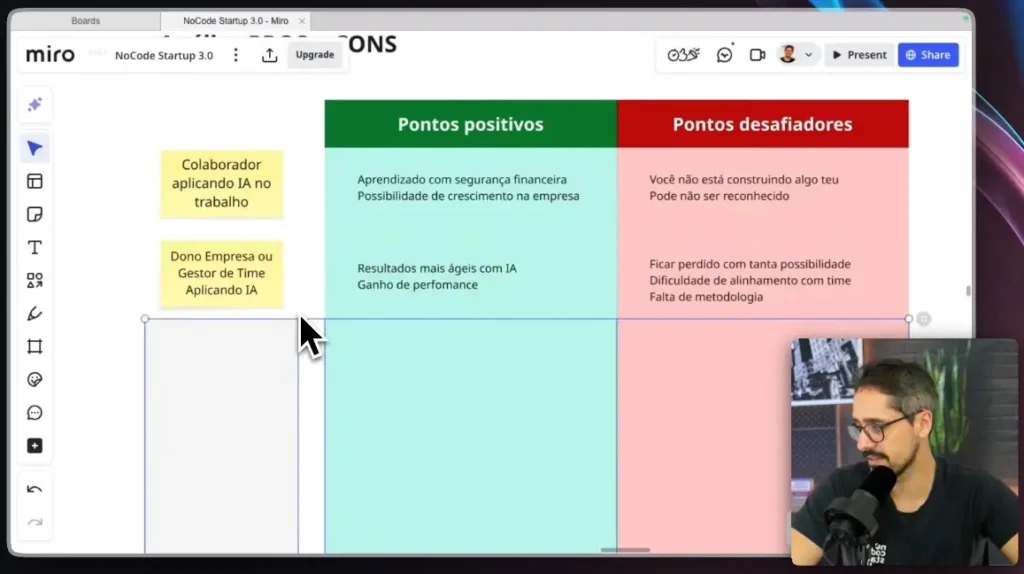

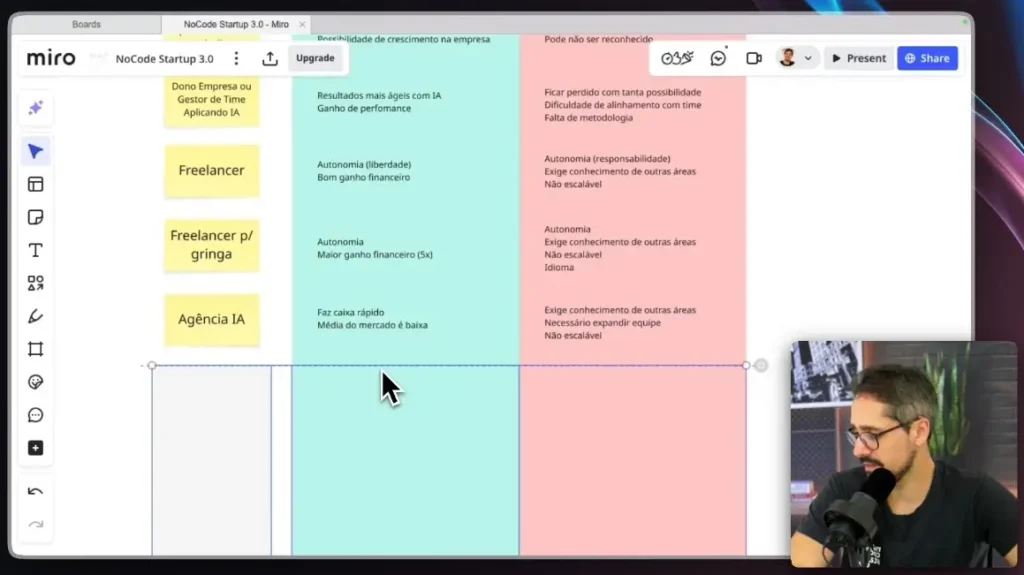

¿Por qué Vibe Coding es el lenguaje de programación ideal para quienes no son desarrolladores?

Vibe Coding está revolucionando el startups al proporcionar un enfoque más accesible y ágil para el desarrollo del software.

El principal atractivo de Vibe Coding para quienes no son desarrolladores es su facilidad de uso.

Dado que utiliza IA para generar código a partir de descripciones simples en lenguaje natural, como mencioné anteriormente, cualquiera, independientemente de su formación técnica, puede crear cualquier cosa, desde aplicaciones hasta automatizaciones complejas.

En otras palabras, prácticamente se elimina la necesidad de comprender lenguajes de programación complicados.

Además, la accesibilidad de Vibe Coding permite a los profesionales de áreas como marketing, diseño u operaciones, que normalmente no tendrían acceso al mundo de la programación, pueden crear sus propias soluciones tecnológicas de forma intuitiva y sin barreras técnicas.

Esto permite a las empresas y a startups innovar de forma más rápida y económica. Estos cambios hacen de Vibe Coding una excelente oportunidad para cualquiera que quiera involucrarse en el desarrollo tecnológico, incluso sin una formación formal en programación.

De esta manera, con la ayuda de las mejores herramientas de Vibe Coding, esta revolución puede volverse aún más accesible y eficiente. ¿Pero qué son? Ya lo veremos más adelante.

¿Qué puedes crear con Vibe Conding? Explora las posibilidades

Vibe Coding ofrece una amplia gama de posibilidades creativas, permitiendo a los profesionales, incluso sin experiencia en programación, desarrollar diversas aplicaciones y soluciones tecnológicas. Las principales creaciones posibles incluyen:

- Aplicaciones web y móviles:con Vibe Coding, es posible crear aplicaciones personalizadas para dispositivos web o móviles, satisfaciendo necesidades específicas sin la complejidad del desarrollo tradicional;

- Automatizaciones y bots:La inteligencia artificial facilita la creación de bots y automatizaciones que pueden realizar tareas repetitivas, como responder correos electrónicos o procesar datos, aumentando la eficiencia operativa;

- Herramientas de productividad:los usuarios pueden desarrollar herramientas que ayuden a la organización personal o a la gestión de proyectos, adaptadas a sus rutinas y preferencias;

- Sistemas de recomendación:la creación de sistemas que sugieren productos, servicios o contenidos en función del comportamiento del usuario se hace accesible, mejorando la experiencia del usuario en las plataformas digitales;

- Prototipos y MVP (Productos Mínimos Viables):Los emprendedores pueden convertir rápidamente sus ideas en prototipos funcionales o MVP, lo que facilita las pruebas de mercado y la validación de conceptos.

Imagínese un diseñador que quiere crear una plataforma personalizada para programar reuniones de manera eficiente, sin tener conocimientos profundos de programación.

Con Vibe Coding, puede describir simplemente la funcionalidad del sistema y la herramienta de IA genera el código para crear una plataforma de programación.

En tan solo unos pasos tendrás una solución práctica y funcional, lista para usar.

Estas posibilidades resaltan el potencial de Vibe Coding para democratizar el desarrollo de software, permitiendo a cualquiera materializar sus ideas tecnológicas de forma rápida y eficiente.

Las 7 mejores herramientas de codificación Vibe para desarrolladores principiantes

Ahora que conoces el poder de Vibe Coding, es hora de explorar algunas de las mejores herramientas de Vibe Coding disponibles para principiantes.

Estas herramientas fueron diseñadas para facilitar la creación de soluciones tecnológicas, incluso sin conocimientos avanzados de programación. Presentaremos las opciones más populares y asequibles para desarrolladores principiantes:

Cursor

La principal ventaja de Cursor es su simplicidad. Permite a cualquier persona crear bots o soluciones complejas simplemente describiendo la “vibra” de lo que desea. La IA genera el código necesario, haciendo el desarrollo accesible a profesionales de diferentes áreas.

Cursor es una herramienta de codificación Vibe que utiliza IA para transformar descripciones simples en código funcional. Con su interfaz intuitiva de arrastrar y soltar, facilita la creación de automatizaciones y aplicaciones sin necesidad de experiencia avanzada en programación.

Además, la herramienta es altamente flexible, adaptándose a diferentes necesidades y permitiendo desde automatizaciones simples hasta integraciones complejas. Su facilidad de uso asegura una curva de aprendizaje rápida para principiantes.Su facilidad de uso asegura una curva de aprendizaje rápida para principiantes.

V0 de Vercel

V0 de Vercel facilita la creación de prototipos y aplicaciones web utilizando inteligencia artificial. Con una interfaz visual intuitiva, genera código a partir de descripciones simples, permitiendo a cualquier persona crear soluciones sin tener que codificar manualmente.

La principal ventaja de V0 de Vercel es la velocidad, ya que acelera el desarrollo y el lanzamiento de productos al ofrecer una fácil integración con otras API para crear soluciones rápidas y eficientes.

Por otro lado, V0 de Vercel es altamente flexible ya que permite crear desde sitios web sencillos hasta aplicaciones complejas, por lo que es ideal tanto para principiantes como para profesionales que buscan eficiencia.

Amable

Lovable es una herramienta de Vibe Coding que simplifica la creación de soluciones software, permitiendo a cualquiera crear aplicaciones con la ayuda de inteligencia artificial.

Utilizando descripciones simples, la herramienta genera automáticamente el código necesario para diversas funciones, lo que hace que el desarrollo sea accesible sin experiencia previa.

La principal ventaja de Lovable es su facilidad de uso. Con una interfaz fácil de usar y capacidades de arrastrar y soltar, cualquier usuario puede crear soluciones rápidas y eficientes sin la complejidad del código tradicional.

Replit

Replit es una herramienta de codificación de Vibe que te permite crear y ejecutar código directamente en el navegador y admite múltiples lenguajes de programación. Su interfaz intuitiva facilita la creación de diseños y prototipos software con la ayuda de IA, sin necesidad de conocimientos profundos de programación.

La principal ventaja de Replit es su facilidad de uso. Permite a cualquier persona comenzar a codificar y probar ideas al instante, ofreciendo una plataforma en línea que elimina la necesidad de configurar entornos complejos.

También vale la pena señalar que Replit es altamente colaborativo, ya que permite que los equipos trabajen juntos en tiempo real, lo que lo hace ideal para proyectos grupales, hackatones o para aprender a programar.

Windsurf

Windsurf es una herramienta de Vibe Coding que utiliza inteligencia artificial para crear soluciones rápidas y prácticas, sin requerir conocimientos avanzados de programación.

Su interfaz sencilla facilita el desarrollo de aplicaciones y automatizaciones, permitiendo a cualquier persona crear soluciones simplemente describiendo lo que desea.

La principal ventaja del windsurf es la eficiencia. Permite crear rápidamente aplicaciones y automatizaciones sin necesidad de aprender lenguajes complejos. La integración con múltiples API facilita agregar funcionalidad potente sin esfuerzo adicional.

Bolt.new

Bolt.new es una herramienta de Vibe Coding que te permite crear rápidamente automatizaciones y aplicaciones con el apoyo de inteligencia artificial. Su interfaz sencilla y directa facilita el desarrollo, permitiendo a cualquier persona, incluso sin experiencia, construir soluciones funcionales.

La principal ventaja de Bolt.new es su velocidad. Te permite crear aplicaciones y automatizaciones en minutos usando descripciones simples. Destaca por su fácil integración con otras plataformas, permitiendo personalizar sus soluciones sin necesidad de codificar.

Además, Bolt.new ofrece flexibilidad, ya sea para automatizaciones simples o flujos más complejos. La herramienta se puede ajustar según sea necesario, lo que la hace ideal para principiantes y profesionales que buscan eficiencia en el desarrollo.

DreamFlow: nueva IA de FlutterFlow

DreamFlow – La nueva IA de FlutterFlow facilita la creación de aplicaciones móviles y web con inteligencia artificial. Su sencilla interfaz visual permite crear soluciones rápidas y funcionales sin tener que codificar manualmente.

Su principal ventaja es la velocidad, ya que permite crear aplicaciones de forma rápida, con fácil integración con APIs, sin necesidad de programación avanzada.

Sin mencionar que DreamFlow también es súper flexible y personalizable, y ofrece funciones para crear todo, desde aplicaciones simples hasta soluciones más complejas, atendiendo tanto a principiantes como a profesionales.

Además de las que hemos mencionado, herramientas como FlutterFlow, Bubble, web y constituir Puede ser considerado por aquellos que quieran desarrollar soluciones más complejas, como aplicaciones web y móviles o automatización.

En consecuencia, estas plataformas no-code permiten a los desarrolladores principiantes crear productos digitales sin escribir código tradicional, acercándolos aún más al concepto de Vibe Coding.

Conclusión

Ya se puede ver que Vibe Coding está transformando el desarrollo de software al democratizar la creación de soluciones tecnológicas, haciéndolas accesibles para todos, incluso aquellos sin habilidades avanzadas de programación.

En este punto, lo único que podemos hacer es probarlo en los portales que hemos mencionado, monitorear la mejora de esta técnica en las herramientas que ya utilizamos y observar cómo puede evolucionar.

Ahora, si quieres aprender más sobre cómo usar estos no-code herramientas y mejora tus habilidades de desarrollo, regístrate en el canal de YouTube y acceder a la Sitio web de inicio de NoCode.

¡Descubre recursos exclusivos que pueden impulsar tu viaje hacia el mundo del desarrollo sin código!