Tiempo estimado de lectura: 9 minutos

¡Descubre el fascinante mundo de los agentes de IA en esta guía completa! Aprenda desde los conceptos básicos de la inteligencia artificial hasta la creación de aplicaciones de IA sin necesidad de codificación.

Tabla de contenido

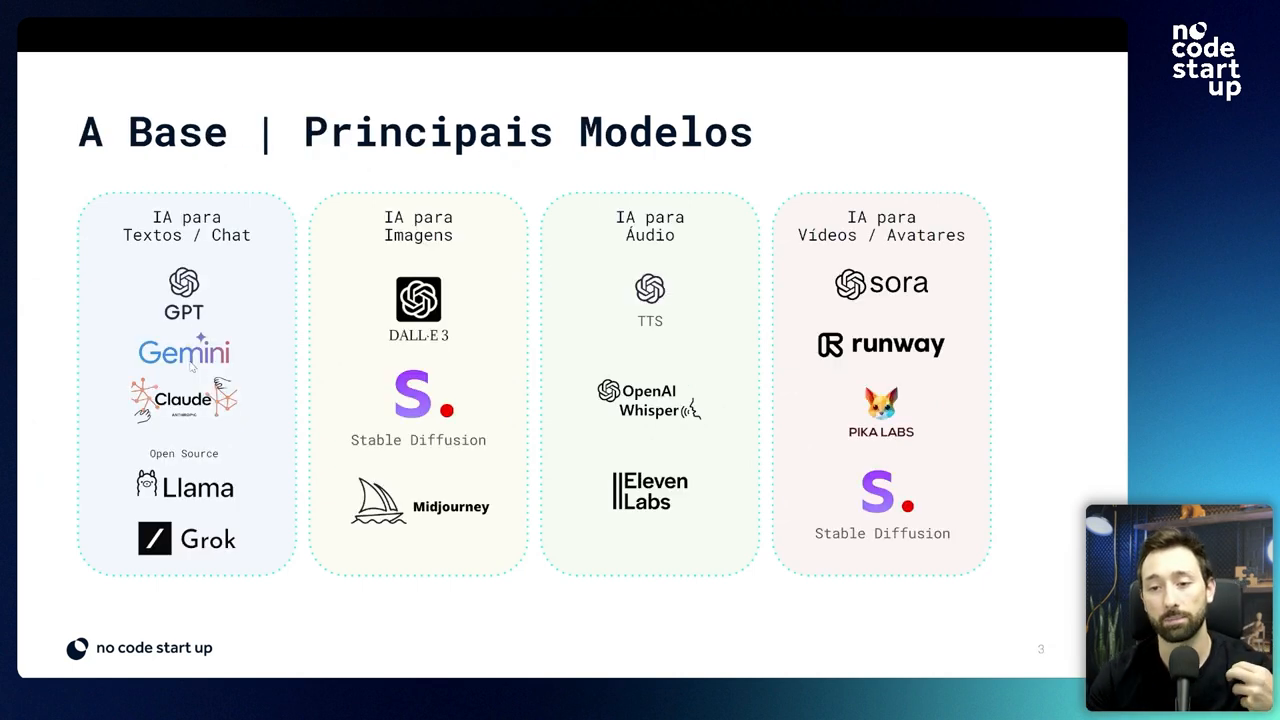

¿Cuáles son las diferentes categorías de IA?

Las categorías de Inteligencia Artificial (IA) varían y cubren una amplia gama de aplicaciones. Exploremos las principales categorías de IA.

IA para texto

En primer lugar, los modelos de IA de texto están diseñados para comprender, generar y manipular texto. Se utilizan ampliamente en chatbots, asistentes virtuales y herramientas de traducción. Algunos ejemplos notables incluyen:

- GPT-4 de OpenAI

- Géminis de Google

- claudio por antrópico

- LLaMA de Facebook

- Gorjeo Grok

IA para imágenes

Además, los modelos de IA para imágenes se utilizan para el reconocimiento, generación y edición de imágenes. Tienen aplicaciones en áreas como el diagnóstico médico, la seguridad y el arte digital. Ejemplos destacados son:

- DALL-E por OpenAI

- Difusión estable

- A mitad del viaje

IA para audio

Los modelos de audio AI se utilizan para el reconocimiento de voz, la síntesis de voz y el análisis de audio. Son imprescindibles en asistentes de voz y transcripción automática. Ejemplos incluyen:

- Susurro de OpenAI

- 11 modelos de laboratorios

IA para vídeo

Finalmente, los modelos de IA para vídeo se aplican en el reconocimiento de objetos, análisis de movimiento y generación de vídeo. Se utilizan en vigilancia, entretenimiento y redes sociales. Ejemplos son:

- Pista

- Difusión estable

- PickLabs

¿Qué es un agente de IA?

Un agente de IA es un concepto central en el campo de la inteligencia artificial. Entendamos mejor qué define a un agente de IA.

Definición de agente de IA

Según la definición de Amazon, un agente de IA es un programa software que puede interactuar con su entorno, recopilar datos y utilizarlos para realizar tareas y lograr objetivos predeterminados.

Autonomía y Objetivos

Además, los agentes de IA están diseñados para actuar de forma independiente. Reciben aportaciones del usuario y eligen las mejores acciones para lograr el objetivo establecido.

Analogía con el agente de viajes

Una buena analogía para entender a un agente de IA es compararlo con un agente de viajes. El agente de viajes recopila diversa información para crear un plan de viaje ideal para el cliente. De manera similar, un agente de IA utiliza diversas herramientas y datos para lograr su objetivo.

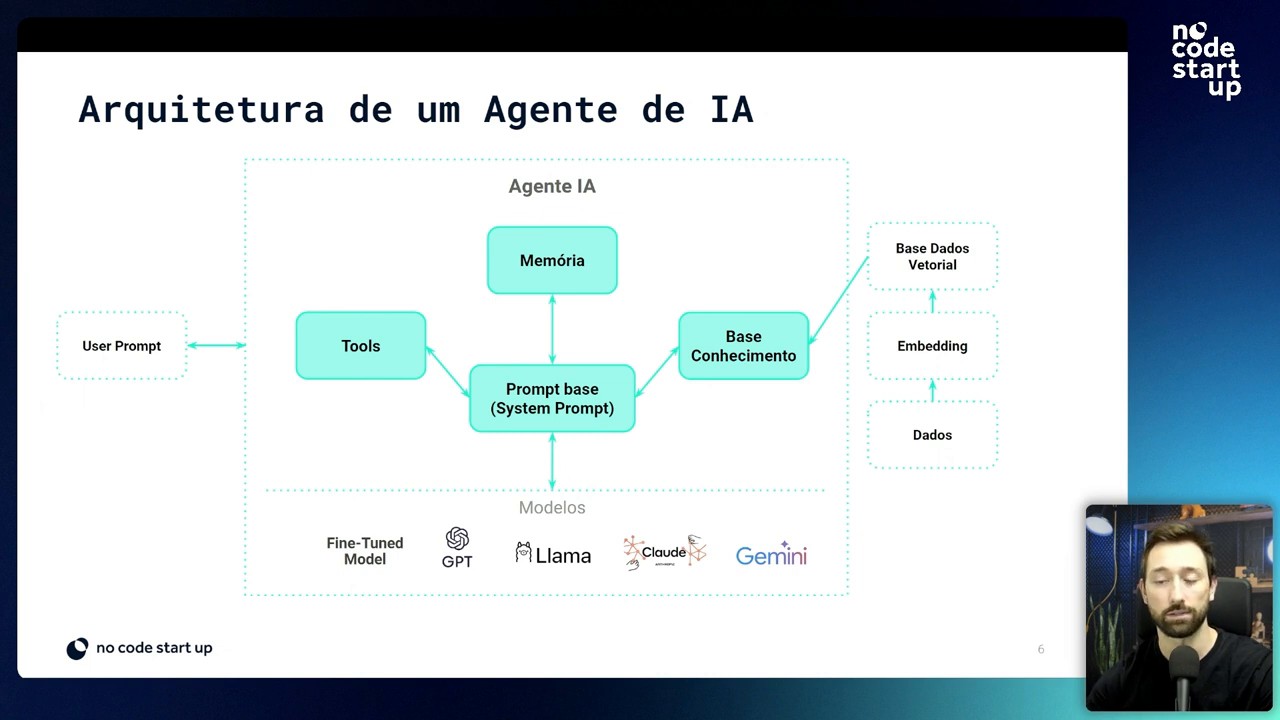

¿Cuál es la arquitectura de un agente de IA?

La arquitectura de un agente de IA se compone de varios componentes esenciales. Exploremos estos componentes en detalle.

Modelos de IA

Los agentes de IA se basan en modelos de IA robustos como GPT, LLaMA, Claude y Gemini. Estos modelos proporcionan la base de conocimientos necesaria para el agente.

Modelos previamente entrenados

Los modelos previamente entrenados o “ajustados” se ajustan con datos específicos para mejorar el desempeño del agente en tareas específicas.

Aviso básico

El mensaje básico es un conjunto de instrucciones que definen las reglas y la personalidad del agente. Orienta al agente sobre lo que puede o no hacer.

Memoria a largo plazo

La memoria a largo plazo permite al agente mantener el contexto de conversaciones anteriores, haciéndola más eficiente e inteligente.

Bases de conocimiento adicionales

Las bases de conocimiento adicionales incluyen documentos específicos, hojas de cálculo y otros datos que el agente puede consultar para proporcionar respuestas más precisas.

- archivos PDF

- Hojas de cálculo de Excel

- Libros

Proceso de indexación

El proceso de indexación transforma datos en vectores que se almacenan en bases de datos vectoriales. Esto permite al agente buscar información de manera eficiente.

Herramientas y funciones

Las herramientas y funciones disponibles para los agentes de IA les permiten realizar tareas específicas, como acceder a Internet o realizar llamadas API.

- Lectura de código

- Acceso a Internet

- llamadas API

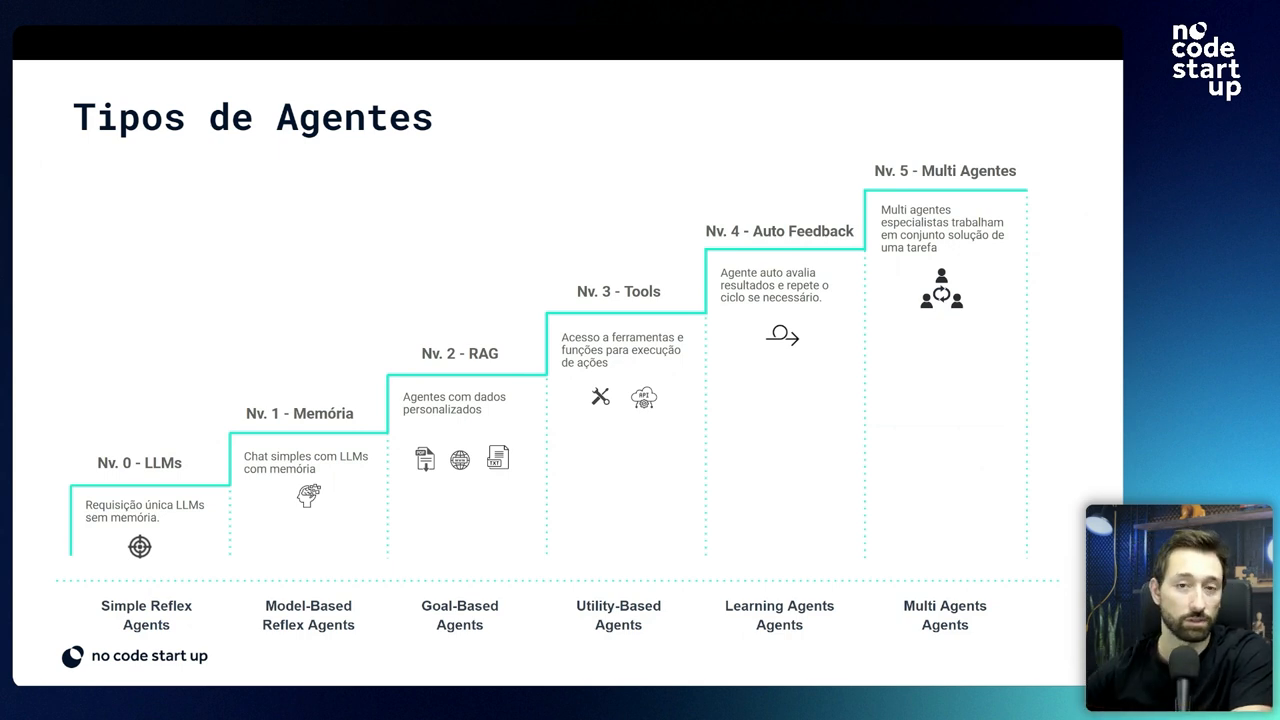

¿Cuáles son los diferentes niveles de agentes de IA?

Los agentes de IA se pueden clasificar en diferentes niveles, desde simples hasta avanzados.

Nivel 0: Agentes Reflejos Simples

En el nivel más básico tenemos los Agentes Reflejos Simples. Estos agentes reaccionan a estímulos inmediatos sin memoria ni contexto.

- Solicitud única para LLM

- Respuestas rápidas y únicas.

- Sin contexto ni memoria

Nivel 1: Agentes reflejos basados en modelos

El siguiente nivel incluye agentes que tienen memoria básica, lo que permite conversaciones simples y de contexto limitado.

- Chat sencillo con LLM

- Memoria de corto plazo

- Contexto limitado

Nivel 2: Generación aumentada de recuperación (RAG)

En el nivel dos, los agentes pueden acceder a bases de conocimiento adicionales para brindar respuestas más informadas.

- Buscar en bases de datos

- Información de PDF, Excel, etc.

- Objetivos específicos

Nivel 3: Agentes basados en servicios públicos

Estos agentes tienen la capacidad de realizar acciones más complejas, como llamadas API, integrándose con otros sistemas.

- Ejecutar acciones vía API

- Integración con CRM y otros sistemas.

- Funciones estructuradas

Nivel 4: Agentes de aprendizaje

Los agentes de nivel cuatro pueden autoevaluar sus resultados y repetir ciclos para mejorar la calidad de las respuestas.

- Autoevaluación de resultados

- Repetir ciclos para mejorar.

- Comentarios internos

Nivel 5: Multiagentes

El nivel más avanzado incluye múltiples agentes que colaboran para lograr un objetivo común de manera eficiente.

- Colaboración entre agentes

- Retroalimentación automática entre agentes

- Meta común

¿Cuál es el escenario actual para los agentes de IA?

El panorama actual de los agentes de IA está evolucionando rápidamente, con avances continuos y nuevas aplicaciones emergentes.

Desarrollo de herramientas

Se están desarrollando varias herramientas para facilitar la creación de agentes de IA en diferentes niveles.

- Herramientas no-code

- Plataformas de desarrollo

- API especializadas

Aplicaciones diversificadas

Los agentes de IA se están aplicando en diversas áreas, desde el servicio al cliente hasta la automatización de procesos comerciales.

- Atención al cliente

- Automatización de procesos

- Soporte técnico

Evolución rápida

Estamos apenas en el comienzo del camino hacia el desarrollo de agentes de IA, con un importante potencial disruptivo.

- Inicio de la construcción

- Evolución acelerada

- Potencial disruptivo

¿Cuál es la diferencia entre un agente de IA y un chatbot tradicional?

Comprender la diferencia entre un agente de IA y un chatbot tradicional es fundamental para elegir la solución adecuada a sus necesidades.

Agentes de IA

Los agentes de IA utilizan inteligencia artificial generativa y procesamiento del lenguaje natural para interactuar de una manera más humana y eficiente.

- Inteligencia artificial generativa

- Procesamiento natural del lenguaje

- Respuestas basadas en el contexto

Chatbots tradicionales

Los chatbots tradicionales siguen un flujo de conversación predefinido, a menudo rígido, basado en secuencias de comandos o bloques construidos manualmente.

- Flujos de conversación predefinidos

- Secuencias de comandos de código

- Interacción limitada

Mezcla de tecnologías

Existe una tendencia creciente a integrar los chatbots tradicionales con tecnologías de inteligencia artificial para crear soluciones más sólidas y adaptables.

- Integración de IA en chatbots

- Consultas de la base de conocimientos

- Respuestas más precisas e informadas

¿Cómo utilizar agentes de IA en aplicaciones no-code?

Los agentes de IA son herramientas poderosas que se pueden integrar en aplicaciones no-code para automatizar procesos y mejorar la eficiencia.

Integración vía API

La integración de agentes de IA en plataformas no-code a menudo se logra mediante llamadas API. Esto permite la comunicación entre diferentes sistemas y la IA.

Con las API, es posible conectar agentes de IA a diversas herramientas y plataformas, como WhatsApp, Instagram y sistemas personalizados creados en la plataforma. FlutterFlow o Bubble.

Herramientas de integración

Herramientas de integración como Make y N2N facilitan la conexión de agentes de IA y otras aplicaciones. Permiten a los usuarios configurar flujos de trabajo sin tener que escribir código.

- constituir

- N2N

- Zapier

Aplicaciones prácticas

Los agentes de IA se pueden integrar en una variedad de aplicaciones, desde chatbots de redes sociales hasta sistemas de automatización empresarial.

- Chatbots en WhatsApp

- Automatización de marketing

- sistemas de atención al cliente