La revolución digital ha llegado con fuerza al aula, y ahora la inteligencia artificial (IA) es el eje central de este movimiento. Ante la creciente demanda de soluciones eficaces, la IA para educadores se ha convertido en una de las áreas más prometedoras de la innovación educativa.

Los educadores que dominan estas herramientas no solo ahorran tiempo, sino que también pueden ofrecer experiencias de aprendizaje más personalizadas y efectivas. Pero, después de todo, ¿cuál es la mejor IA para el profesorado? ¿Cómo se puede aplicar en la vida escolar diaria sin complicaciones? Y lo más importante: ¿cómo beneficia directamente a los estudiantes?

En este artículo, descubrirá las tecnologías, herramientas y agentes de IA clave que están transformando el panorama educativo, además de recomendaciones prácticas que puede aplicar ahora mismo.

¿Qué es la IA en la educación y por qué debería usted, como educador, comprenderla?

La inteligencia artificial en educación se refiere al uso de algoritmos y agentes inteligentes para facilitar, personalizar o automatizar las tareas de enseñanza y aprendizaje. Esto abarca desde la creación de planes de clase hasta la monitorización del rendimiento estudiantil en tiempo real.

Las herramientas de IA permiten:

- Reducir el tiempo dedicado a tareas administrativas;

- Personaliza las actividades según el perfil de cada alumno;

- Cree evaluaciones y contenido interactivo de forma automática;

- Optimizar la planificación pedagógica y la gestión del aula.

Conoce a: Curso de Agentes con OpenAI de No Code Start Up

¿Cómo ayuda la IA a los docentes en la práctica?

La IA ayuda a los educadores en múltiples frentes:

- Planificación de leccionesHerramientas como Canva Magic Write y Curipod están transformando la forma en que los docentes preparan sus clases. En lugar de empezar desde cero, simplemente introduce un tema u objetivo y estas herramientas generan una estructura didáctica completa: introducción, desarrollo, ejercicios interactivos y conclusión.

Esto permite una preparación más eficiente, ahorrando horas de trabajo. Además, estos recursos garantizan la alineación con las directrices curriculares, como la BNCC, y ofrecen sugerencias visuales y metodológicas adaptadas al perfil de la clase.

La personalización es uno de los mayores beneficios: el profesor puede ajustar fácilmente las sugerencias a la realidad del aula y al nivel de aprendizaje de los alumnos. - Creación de contenido:Los agentes generativos como ChatGPT, Claude y Eduaide.Ai permiten a los profesores desarrollar una amplia gama de contenidos pedagógicos de forma rápida y eficiente.

Con solo unos pocos comandos, puedes generar textos explicativos sobre cualquier tema, crear resúmenes temáticos, crear cuestionarios interactivos con retroalimentación automática e incluso guionar presentaciones visuales para usar en el aula o en la enseñanza a distancia.

- Automatización de evaluaciones:Corregir y preparar evaluaciones siempre ha requerido tiempo y atención por parte de los docentes, pero con el uso de herramientas basadas en IA, este proceso se vuelve mucho más ágil y confiable.

Plataformas como Gradescope permiten cargar pruebas escaneadas y aplicar criterios de corrección previamente definidos, generando resultados instantáneos con un alto grado de precisión.

Herramientas como ChatGPT pueden ayudar a crear preguntas de ensayo, preguntas de opción múltiple o incluso evaluaciones gamificadas, basadas en temas curriculares proporcionados por el profesor. - Mentoría personalizadaLa inteligencia artificial permite un enfoque mucho más individualizado de la enseñanza. Al analizar datos sobre el rendimiento, la participación y el comportamiento de los estudiantes, las herramientas de IA pueden identificar patrones y brechas de aprendizaje que, de otro modo, pasarían desapercibidas.

A partir de estos conocimientos, los docentes pueden ofrecer feedback personalizado, proponer actividades específicas de refuerzo e incluso adaptar el ritmo y el enfoque de enseñanza según las necesidades de cada alumno.

Esto fortalece el vínculo pedagógico, aumenta el compromiso de los estudiantes y mejora significativamente los resultados académicos, haciendo que la experiencia de aprendizaje sea más justa, humana y efectiva.

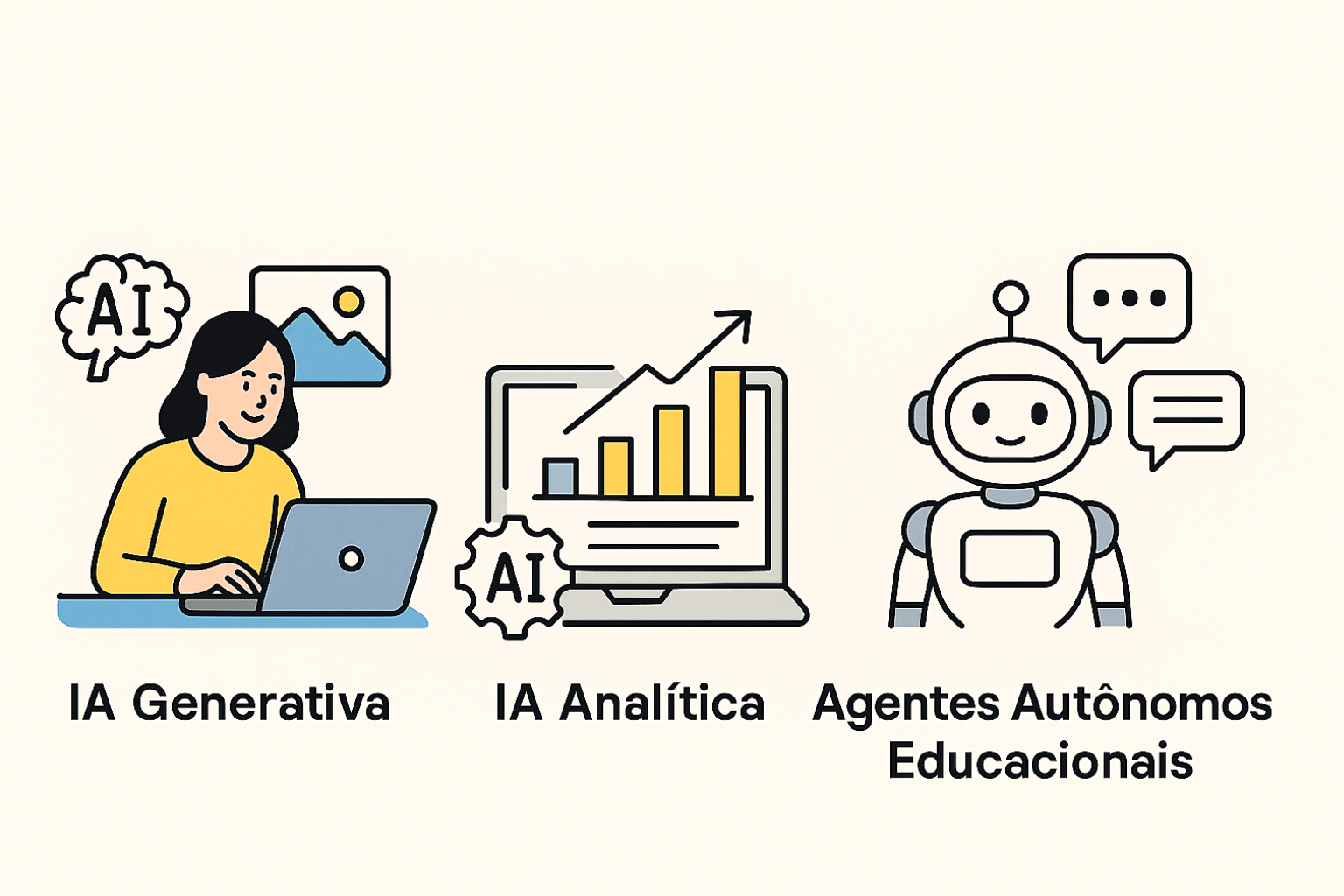

Tipos de Inteligencia Artificial utilizados en la Educación

IA generativa

Herramientas como ChatGPT, Claude y Dify permiten generar contenido textual y multimodal (como imágenes y vídeos) bajo demanda. Pueden utilizarse para planificar clases, crear materiales didácticos o proporcionar explicaciones alternativas para las tutorías.

IA analítica

Soluciones como Google Classroom con IA, MagicSchool.ai y ClassDojo monitorean las interacciones y el desempeño de los estudiantes para adaptar estrategias pedagógicas de manera personalizada.

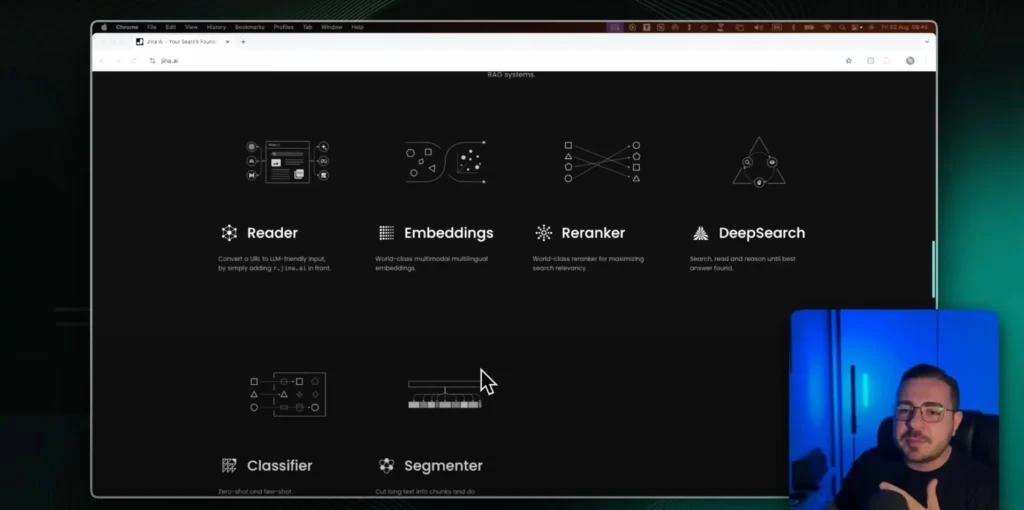

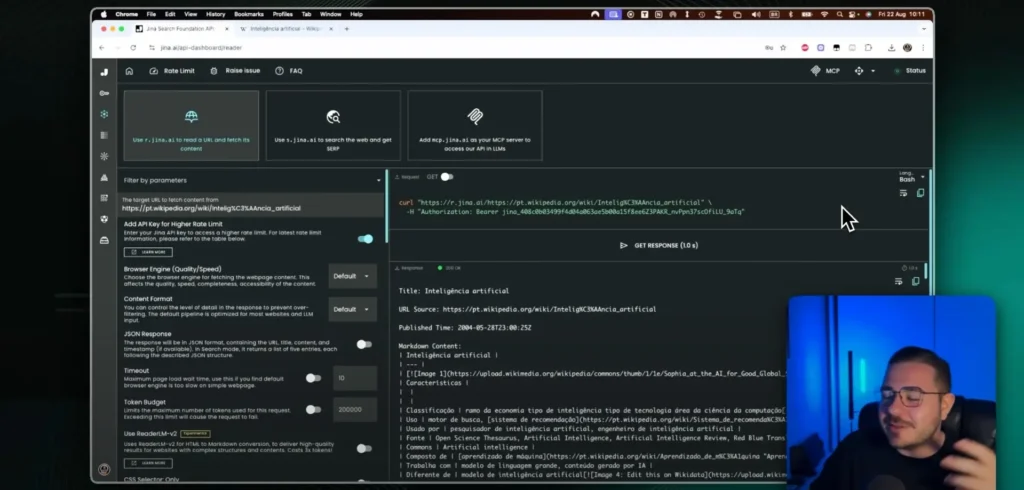

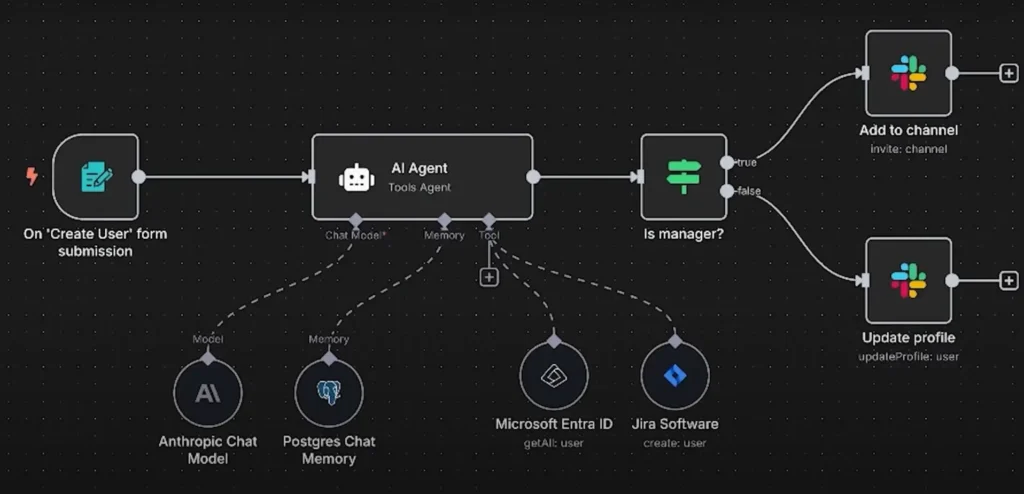

Agentes Educativos Autónomos

Los educadores pueden crear agentes con n8n o Dificar para automatizar tareas como informes, alertas de rendimiento, entrega de actividades y más.

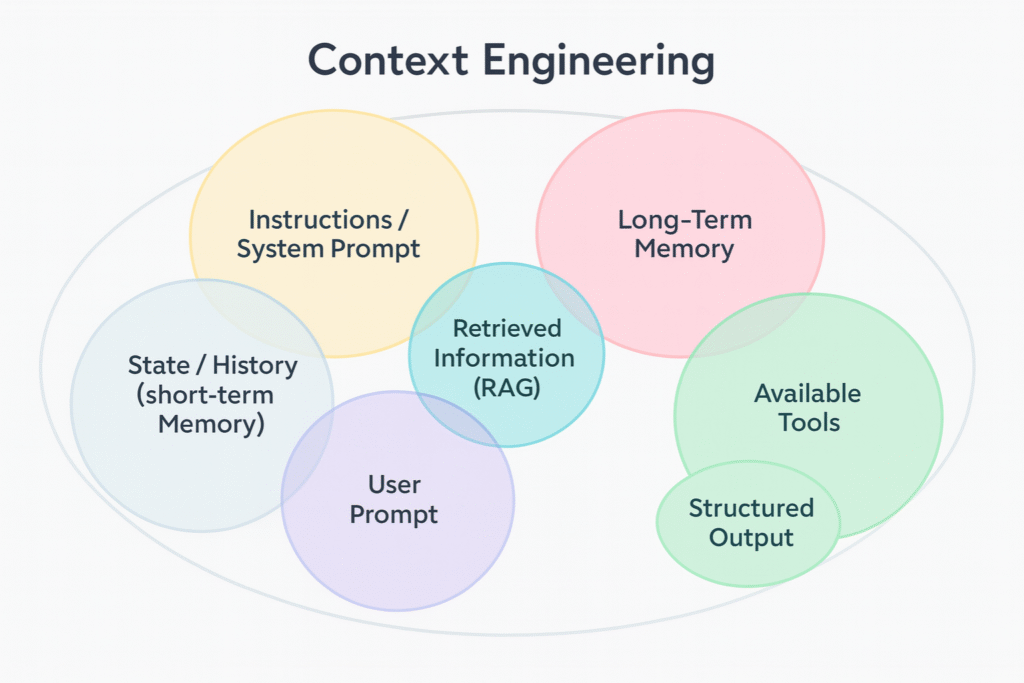

Agentes de IA: El futuro de la educación personalizada

Tú Agentes autónomos con IA Representan el siguiente nivel de innovación pedagógica. Son capaces de operar de forma continua y adaptativa, basándose en comandos predefinidos y lógica contextual.

Ejemplos de uso:

- Agente tutor para responder preguntas de los estudiantes vía WhatsApp o Plurall;

- Agente evaluador para generar reportes por estudiante en función del desempeño en plataformas educativas;

- Agente de contenidos que genera material nuevo cada semana basado en el currículo de la escuela.

Descubra más en Capacitación de AI Agent Manager para puesta en marcha sin código

Herramientas de IA que todo educador debe conocer

Curipod

O Curipod Es una plataforma que permite crear clases interactivas en tan solo unos minutos con IA. Los profesores pueden introducir un tema y recibir automáticamente una estructura de clase con textos, cuestionarios, encuestas, imágenes y otras actividades. Es ideal para quienes buscan dinamismo e interacciones más atractivas en el aula.

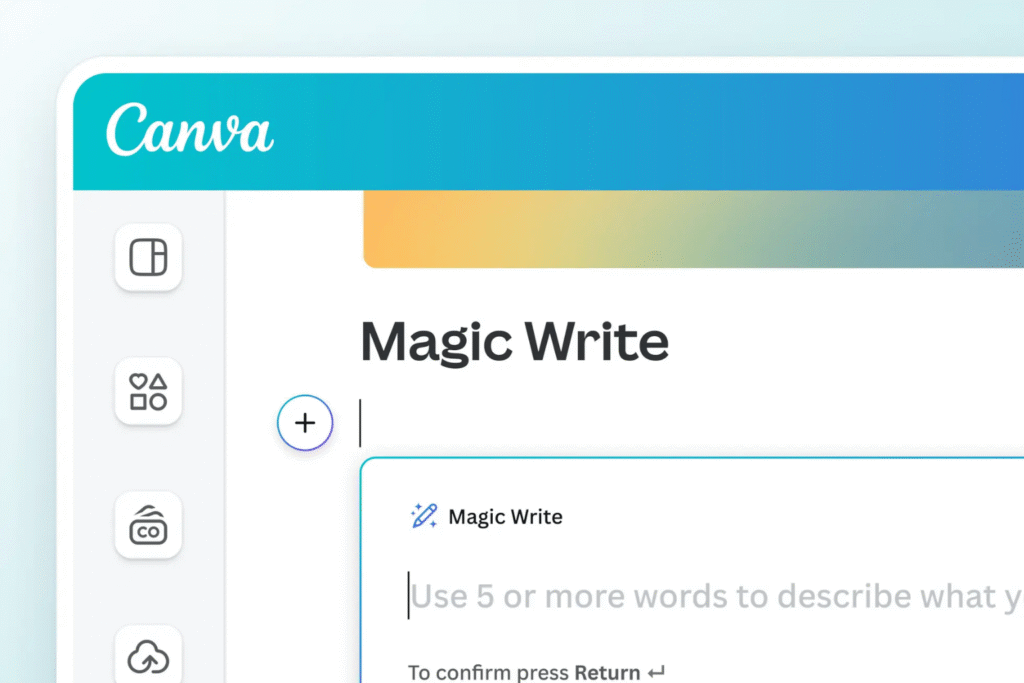

Escritura mágica de Canva

Integrado con Canva, Escritura mágica Es un generador de contenido con tecnología de IA que ayuda a los educadores a crear diapositivas, presentaciones, resúmenes y materiales visuales en tiempo récord. Simplemente introduce una idea o tema y la herramienta sugiere textos coherentes, visualmente listos para su uso educativo.

AudioPen

AudioPen Convierte automáticamente la voz en texto, lo que lo hace ideal para educadores que prefieren dictar ideas en lugar de escribirlas. Se puede usar para crear planes de clase, guiones de video, contenido para blogs educativos y más. Es simple, práctico y rápido.

Eduaide.Ai

Esta herramienta ofrece más de 100 recursos para crear contenido educativo de alta calidad. Desde planes de clase completos, sugerencias de estudio y retroalimentación personalizada hasta metodologías activas, todo generado con IA y disponible en varios idiomas. Más información. Eduardo.AI

Escuela de Magia.ai

Plataforma dirigida exclusivamente a educadores, la Escuela de Magia.ai centraliza la generación de planes de clase, informes de rendimiento, cuestionarios y diversos contenidos. Un auténtico panel de control integral para quienes desean aumentar la productividad en la gestión pedagógica.

Copilot para la Educación (Microsoft)

O Copiloto Se integra con Microsoft 365, lo que permite a los docentes automatizar la creación de contenido y las tareas administrativas. Desde responder correos electrónicos hasta crear presentaciones con IA, es un potente aliado para optimizar el tiempo dentro y fuera del aula.

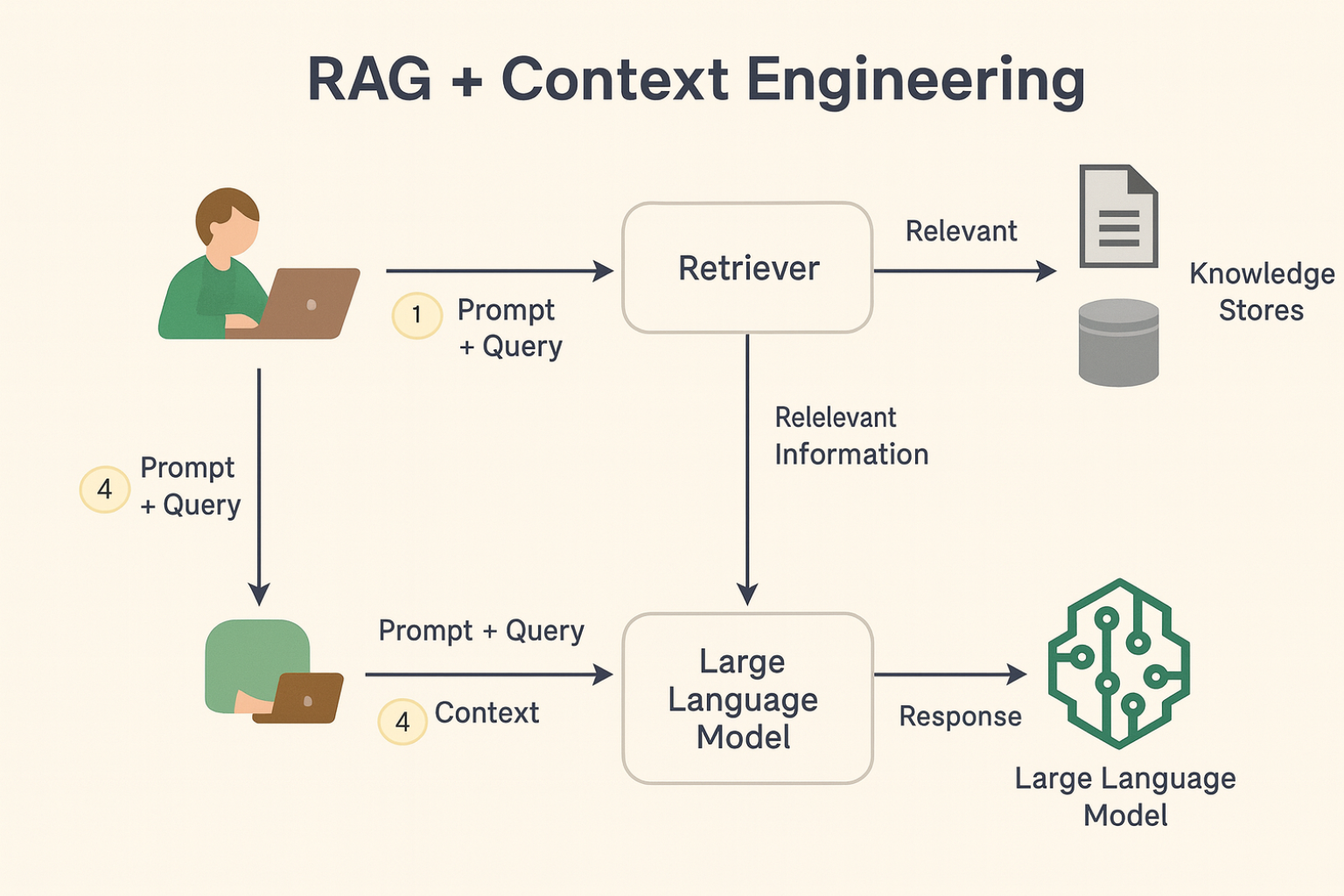

Dify + OpenAI

Ideal para quienes desean personalizar sus propios agentes educativos. Con Dificar, conectas modelos de la AbiertoAI en flujos de trabajo prácticos, como un agente para revisar ensayos, otro para calificar exámenes o incluso un bot para apoyar a los padres de los estudiantes.

Lea también: Curso de FlutterFlow para aplicaciones educativas

Automatización de tareas pedagógicas: más tiempo para enseñar

Tareas como proporcionar retroalimentación, organizar datos, enviar notificaciones e incluso corregir exámenes pueden automatizarse. Esto permite a los docentes centrarse en las interacciones humanas, la creatividad y la supervisión minuciosa de los estudiantes.

Soluciones como Crear curso (Integromat) y Curso Xano Puede integrarse con plataformas de enseñanza para facilitar estos procesos.

Preguntas frecuentes sobre IA para educadores

¿Cuál es la mejor IA para profesores?

No hay una única respuesta, ya que depende del objetivo. Para la creación de contenido, ChatGPT y Eduaide.Ai destacan. Para la planificación de clases, Curipod ofrece una estructura predefinida.

Para la evaluación, Gradescope y MagicSchool.ai son buenas opciones. Lo ideal es combinar herramientas según la necesidad pedagógica.

¿Cuáles son los tipos de IA que se utilizan en la educación?

Los tipos principales son:

- IA generativa (como ChatGPT y Dify), utilizada para crear textos, actividades e incluso vídeos;

- IA analítica, que interpreta los datos sobre el rendimiento y el comportamiento de los estudiantes;

- Agentes autónomos, que realizan tareas educativas sin supervisión constante, como corregir exámenes o enviar retroalimentación.

¿Cuál es el mejor sitio web de IA para profesores?

Plataformas como MagicSchool.ai, Eduaide.Ai y Canva Magic Write ofrecen soluciones robustas para docentes. En el ecosistema brasileño, Inicio sin código Destaca por su formación práctica centrada en la IA aplicada a la educación.

¿Cómo puede la IA ayudar a los profesores?

Ayuda a automatizar tareas repetitivas, crear contenido personalizado, ofrecer análisis de datos en tiempo real y permitir una gestión más eficiente del aula. Esto libera tiempo y mejora significativamente la calidad de la enseñanza.

La IA para educadores es un camino de un solo sentido, y hay que estar preparado

La IA en la educación es más que una tendencia: es una realidad transformadora. Los educadores que aprenden a integrar estas tecnologías en su vida diaria ahorran tiempo, aumentan el impacto de su trabajo y mejoran la calidad de la enseñanza.