Imagina que tienes un asistente superinteligente entrenado en base a todo el conocimiento disponible en Internet. Sin embargo, cuando se trata de información específica de su negocio, es posible que no tenga referencias directas. Entonces ¿cómo se soluciona esta limitación?

Una de las formas más efectivas de mejorar la inteligencia de su asistente es entrenarlo con datos personalizados, como documentos, artículos y archivos internos.

Esta técnica se conoce como RAG (Recuperación-Generación Aumentada) y permite a los asistentes de IA combinar conocimientos preexistentes con información específica para proporcionar respuestas más precisas y útiles.

Continúe leyendo para comprender mejor cómo este enfoque puede transformar el uso de la IA en su negocio.

¿Cómo funciona RAG (Recuperación-Generación Aumentada)?

Ahora que entendemos el concepto de RAG (Recuperación-Generación Aumentada), exploremos cómo funciona en detalle.

A diferencia de los asistentes de IA tradicionales que simplemente generan respuestas basadas en conocimientos previamente entrenados, RAG busca información de fuentes externas y combina esos datos con su conocimiento previo para proporcionar respuestas más precisas y relevantes.

El proceso se puede dividir en tres pasos principales:

Pregúntele al modelo de IA

El usuario le hace una pregunta al asistente de IA, tal como lo haría en ChatGPT u otro chatbot tradicional.

Búsqueda de información (recuperación)

El asistente de IA consulta una base de datos específica, como archivos PDF, sitios web, documentos internos o una base de conocimiento empresarial. Recupera la información más relevante para responder la pregunta.

Generación aumentada

Con los datos recuperados, la IA refina y estructura la respuesta, combinando información del banco de conocimiento con su propio modelo lingüístico. Esto garantiza una respuesta contextualizada, precisa y relevante.

Este método es muy eficiente ya que permite a la IA proporcionar respuestas más personalizadas basadas en datos internos. Además, la tecnología puede aprovechar la documentación del producto, respaldar bases de conocimiento e incluso políticas corporativas para garantizar información precisa y relevante.

Sin embargo, a diferencia de un chatbot convencional, que responde basándose únicamente en su entrenamiento original, un modelo RAG puede actualizarse constantemente con nueva información, sin necesidad de un reentrenamiento masivo.

En otras palabras, esto permite que la IA sea altamente dinámica y evolucione progresivamente a medida que se agregan nuevos contenidos, garantizando una mayor precisión y relevancia en las respuestas.

Por ejemplo, dentro de la comunidad NoCode, proporcionamos asistentes que usan RAG para responder preguntas sobre herramientas como constituir, Diferencia, N8N y Bubble.

Además, estos asistentes han sido formados con documentación específica para estas plataformas, lo que les permite ofrecer respuestas aún más detalladas y precisas a los alumnos, facilitando así el aprendizaje y la resolución de consultas técnicas.

5 beneficios de usar RAG

Ahora que entiendes cómo funciona RAG, exploremos los principales beneficios que esta tecnología puede aportar a las empresas y a los usuarios:

1. Respuestas más precisas y contextualizadas

RAG permite a los asistentes de IA consultar información actualizada en tiempo real, haciendo que las respuestas sean más relevantes y detalladas.

2. Automatización y eficiencia

Con la capacidad de acceder a bases de conocimiento específicas, la IA reduce la necesidad de soporte humano constante, optimizando el tiempo y los recursos.

3. Aprendizaje continuo sin necesidad de reciclaje

A diferencia de los modelos de IA tradicionales, que necesitan ser entrenados y reentrenados constantemente para aprender nueva información, RAG puede simplemente consultar bases de datos actualizadas.

4. Personalización para diferentes negocios

Las empresas pueden adaptar la IA para responder preguntas específicas de la industria capacitando al asistente con manuales técnicos, bases de conocimiento internas y otros documentos relevantes.

5. Aplicación de RAG en la atención al cliente

Además del uso académico y educativo, empresas de diversos sectores están utilizando RAG para mejorar la atención al cliente.

Imagine una empresa de tecnología que vende software complejos. Los clientes a menudo se comunican con el soporte con preguntas sobre funciones específicas.

Con un asistente de IA entrenado con RAG, la empresa puede alimentar a la IA con su base de conocimiento interna, manuales técnicos y preguntas frecuentes. De esta manera, el agente puede responder preguntas con precisión y rapidez, lo que ayuda a reducir la necesidad de intervención humana y optimizar la atención al cliente.

¿Cómo aplicar RAG en tu negocio?

Empresas de diferentes segmentos pueden aprovechar esta tecnología para mejorar los procesos internos, la atención al cliente y la automatización de tareas. A continuación, consulte algunas estrategias prácticas para aplicar RAG a su negocio.

1. Identifica las principales necesidades de tu empresa

Antes de integrar RAG, evalúe qué áreas de su negocio pueden beneficiarse de esta tecnología. Hazte las siguientes preguntas:

- ¿El servicio de atención al cliente recibe muchas preguntas repetitivas?

- ¿Su equipo necesita acceder a documentos técnicos con frecuencia?

- ¿Existe una base de datos grande que podría utilizarse mejor?

- ¿Podría optimizarse el entrenamiento interno con un asistente de IA?

2. Elija las fuentes de datos adecuadas

El mayor diferenciador de RAG es su capacidad de buscar información de fuentes externas. Para garantizar respuestas precisas y confiables, es esencial seleccionar los mejores repositorios de datos. Algunas opciones incluyen:

- documentación técnica y manuales de productos;

- Preguntas frecuentes y bases de conocimiento internas;

- artículos, investigaciones y estudios de casos;

- datos estructurados de CRMS y ERPS;

- Archivos PDF, hojas de cálculo y Notion.

3. Integre RAG con sus herramientas existentes

Para obtener mejores resultados, RAG debe estar conectado a las plataformas que su equipo ya utiliza. Algunas formas de integración incluyen:

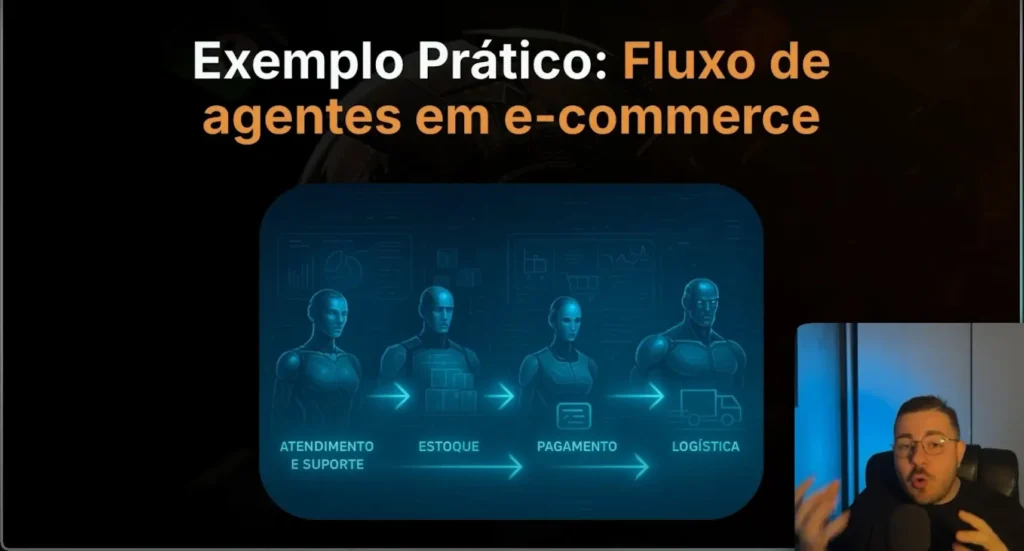

- Chatbots y asistentes virtuales: IA entrenada para responder preguntas recurrentes y brindar soporte técnico;

- Sistemas de gestión (CRM/ERP): La IA puede acceder a los datos de los clientes para ofrecer respuestas más personalizadas;

- E-learning y formación corporativa: asistentes inteligentes que ayudan a los empleados a acceder rápidamente a los materiales de aprendizaje;

- Comercio electrónico y atención al cliente: chatbots que verifican inventario, políticas de devolución y recomendaciones de productos.

4. Evaluar y optimizar

La implementación de RAG no termina con la configuración inicial. Es esencial monitorear el rendimiento de la IA analizando métricas como:

- tasa de precisión de respuesta;

- satisfacción del usuario;

- reducción del tiempo de servicio;

- Preguntas más frecuentes y oportunidades de mejora.

Con esta información, puede mejorar la base de datos de IA y garantizar que las respuestas sean cada vez más precisas.

Conclusión

Ya sea para mejorar la atención al cliente, automatizar procesos o optimizar la gestión interna del conocimiento, RAG es una solución potente y asequible para empresas de diferentes segmentos.

Con esta tecnología, Agentes de IA Puede acceder a bases de conocimientos específicas, mejorar la experiencia del usuario y reducir la necesidad de una formación extensa.

Si quieres aprender a crear asistentes de IA inteligentes usando N8N, consulta el curso completo de NoCode Startup. En él, tendrás acceso a formación práctica sobre automatización e integración de datos para hacer aún más eficiente la IA de tu negocio.

Explora más sobre el Curso N8N – Startup sin código ¡y empieza a transformar tu empresa con inteligencia artificial!