A revolução digital chegou com força total às salas de aula — e agora, a inteligência artificial (IA) está no centro desse movimento. Com a crescente demanda por soluções eficazes, a IA para educadores tem se tornado uma das áreas mais promissoras da inovação educacional.

Educadores que dominam essas ferramentas não apenas ganham tempo, como conseguem oferecer experiências de aprendizado mais personalizadas e eficazes. Mas afinal, qual a melhor IA para professores? Como aplicá-la no cotidiano escolar sem complicação? E o mais importante: como isso beneficia diretamente os alunos?

Neste artigo, você vai descobrir as principais tecnologias, ferramentas e agentes de IA que estão transformando o cenário educacional — além de recomendações práticas para aplicar agora mesmo.

Conteúdo

O que é IA na educação e por que você, educador, deve entender?

A inteligência artificial na educação refere-se ao uso de algoritmos e agentes inteligentes para facilitar, personalizar ou automatizar tarefas de ensino e aprendizagem. Isso inclui desde a criação de planos de aula até o acompanhamento do desempenho dos estudantes em tempo real.

Ferramentas de IA permitem:

- Reduzir o tempo gasto em tarefas administrativas;

- Personalizar atividades de acordo com o perfil de cada aluno;

- Criar avaliações e conteúdos interativos de forma automática;

- Otimizar o planejamento pedagógico e a gestão da sala de aula.

Conheça o: Curso Agentes com OpenAI da No Code Start Up

Como a IA ajuda professores na prática?

A IA ajuda educadores em múltiplas frentes:

- Planejamento de aulas: Ferramentas como o Canva Magic Write e o Curipod estão transformando a forma como educadores preparam suas aulas. Em vez de começar do zero, basta inserir um tema ou objetivo para que essas ferramentas gerem uma estrutura didática completa — com introdução, desenvolvimento, exercícios interativos e fechamento.

Isso permite uma preparação mais eficiente, economizando horas de trabalho. Além disso, esses recursos garantem alinhamento com diretrizes curriculares, como a BNCC, e oferecem sugestões visuais e metodológicas adaptadas ao perfil da turma.

A personalização é um dos maiores ganhos: o professor pode facilmente ajustar as sugestões à realidade da sala de aula e ao nível de aprendizagem dos alunos. - Criação de conteúdo: Agentes generativos como ChatGPT, Claude e Eduaide.Ai permitem que professores desenvolvam uma ampla gama de conteúdos pedagógicos com rapidez e eficiência.

Com poucos comandos, é possível gerar textos explicativos sobre qualquer disciplina, elaborar resumos temáticos, construir quizzes interativos com feedback automático e até roteirizar apresentações visuais para uso em sala de aula ou no ensino remoto.

- Automatização de avaliações: A correção e elaboração de avaliações sempre exigiram tempo e atenção dos professores — mas com o uso de ferramentas baseadas em IA, esse processo se torna muito mais ágil e confiável.

Plataformas como Gradescope permitem o upload de provas digitalizadas e aplicam critérios de correção definidos previamente, gerando resultados instantâneos com alto grau de precisão.

Já ferramentas como o ChatGPT podem auxiliar na criação de questões dissertativas, de múltipla escolha ou até avaliações gamificadas, com base em temas curriculares fornecidos pelo docente. - Mentoria personalizada: A inteligência artificial permite uma abordagem de ensino muito mais individualizada. Por meio da análise de dados de desempenho, participação e comportamento dos alunos, ferramentas de IA conseguem identificar padrões e lacunas de aprendizado que muitas vezes passariam despercebidos.

Com base nesses insights, os professores podem oferecer feedbacks personalizados, propor atividades específicas para reforço e até adaptar o ritmo e a abordagem de ensino conforme a necessidade de cada estudante.

Isso fortalece o vínculo pedagógico, aumenta o engajamento dos alunos e melhora significativamente os resultados acadêmicos — tornando a experiência de aprendizado mais justa, humana e eficaz.

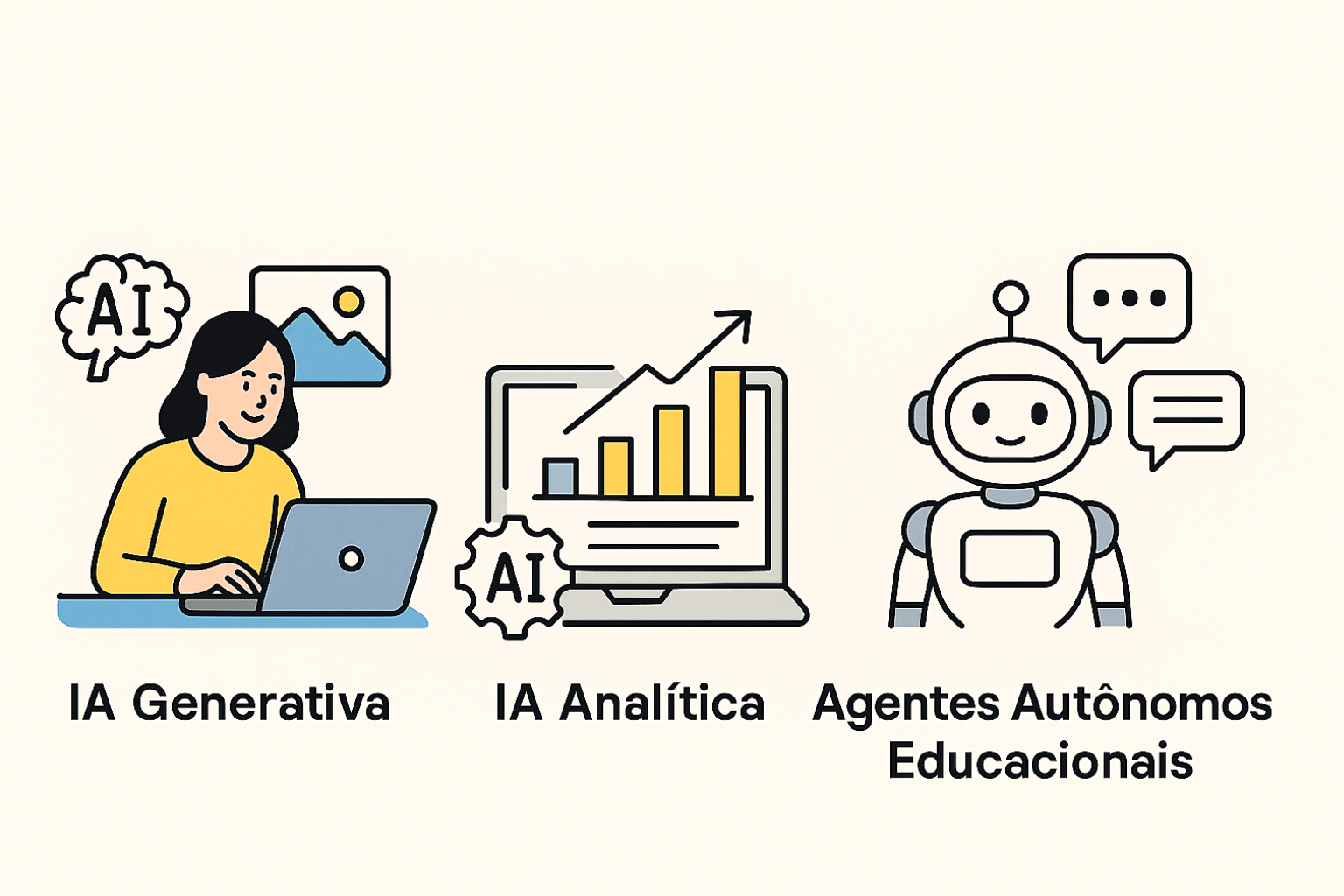

Tipos de Inteligência Artificial utilizados na Educação

IA Generativa

Ferramentas como ChatGPT, Claude e Dify são capazes de gerar conteúdo textual e multimodal (como imagens e vídeos) sob demanda. Podem ser usadas para planejar aulas, criar material didático ou fornecer explicações alternativas para reforço escolar.

IA Analítica

Soluções como Google Classroom com IA, MagicSchool.ai e ClassDojo monitoram interações e desempenho dos alunos para adaptar estratégias pedagógicas de forma personalizada.

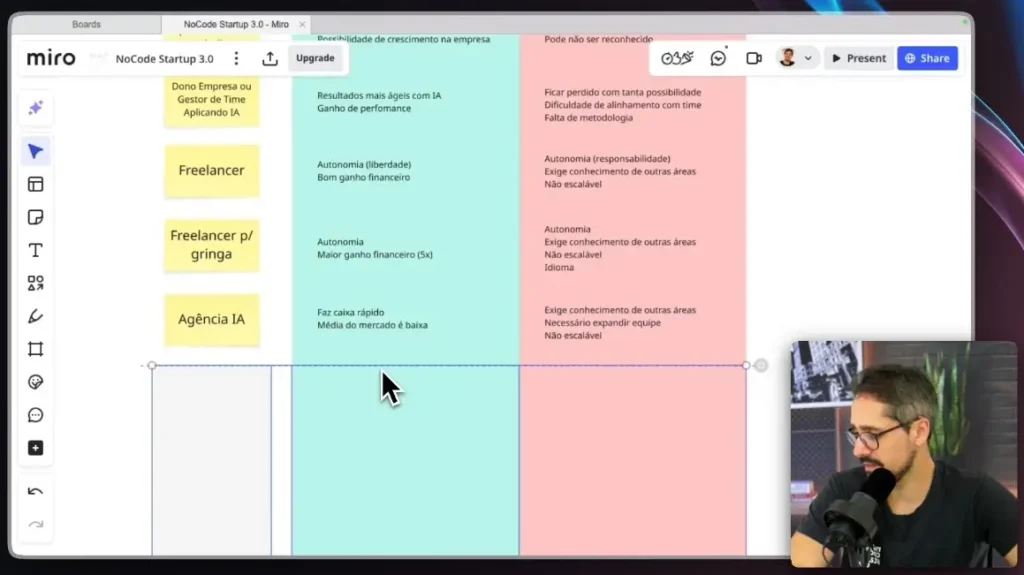

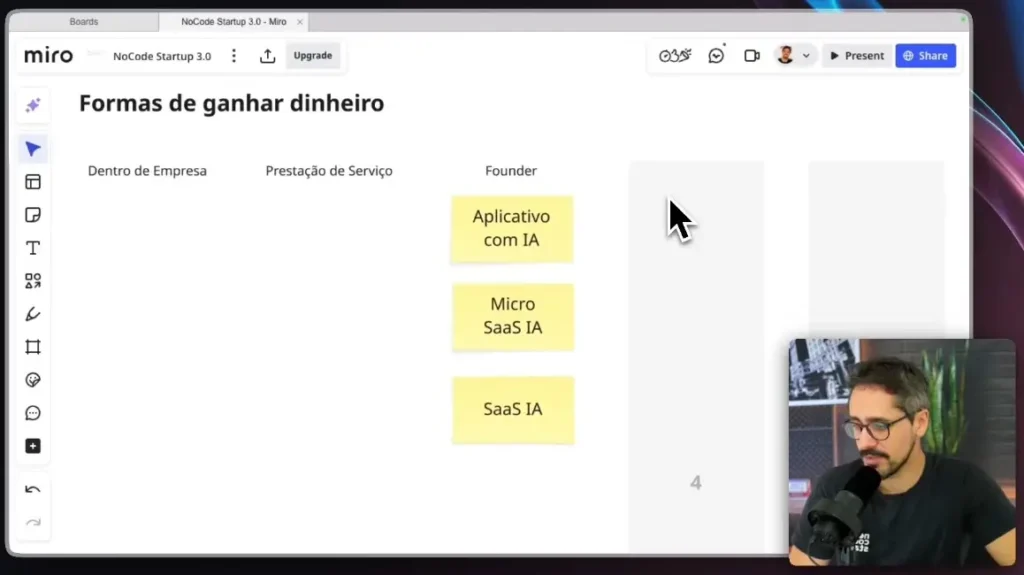

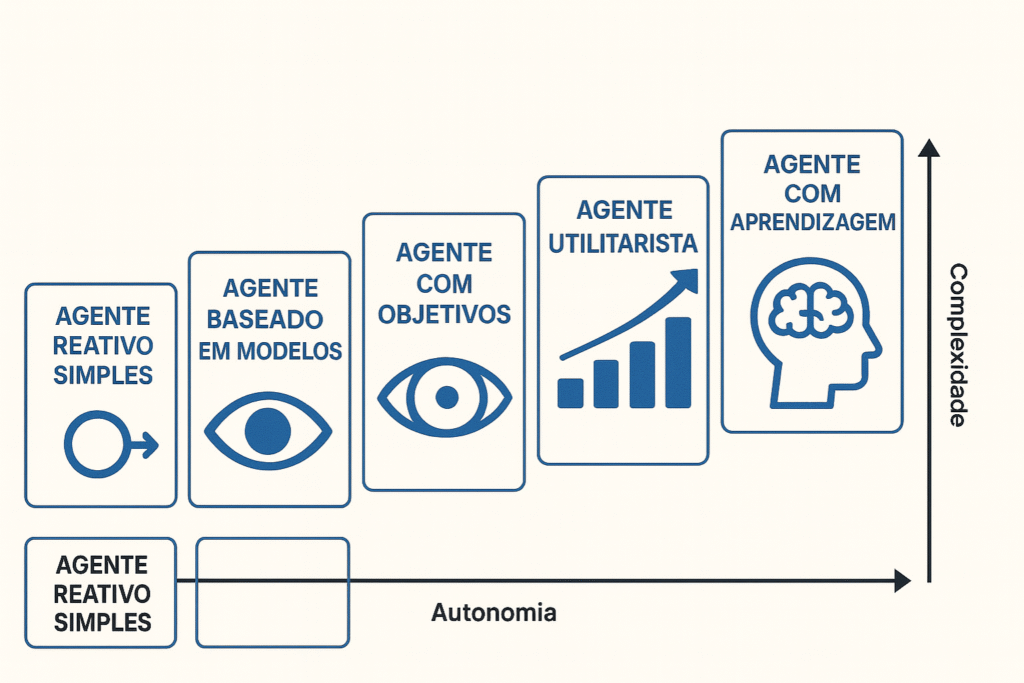

Agentes Autônomos Educacionais

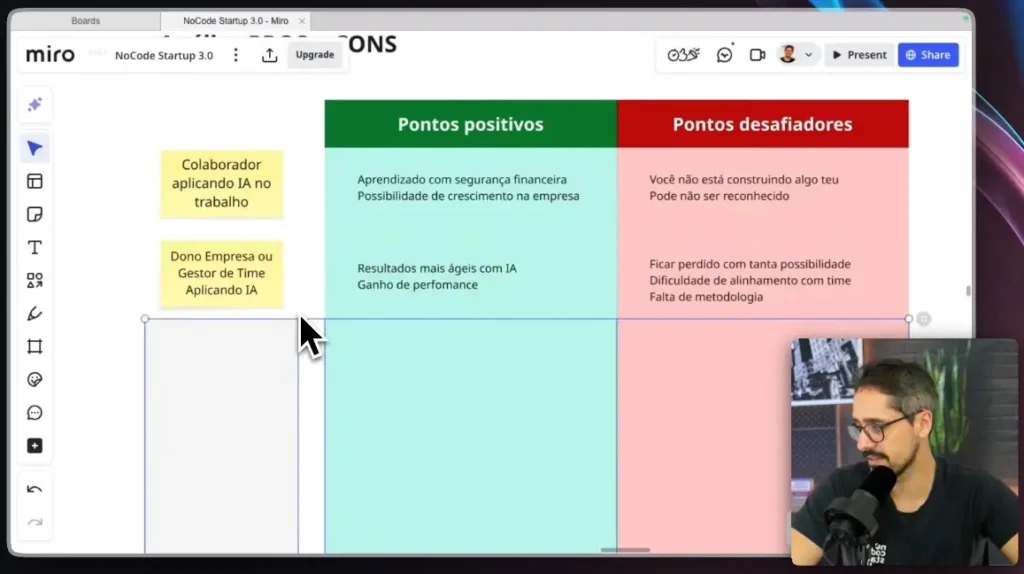

Educadores podem criar agentes com n8n ou Dify para automatizar tarefas como geração de relatórios, alertas de desempenho, entrega de atividades e mais.

Agentes de IA: o futuro da educação personalizada

Os Agentes Autônomos com IA representam o próximo nível da inovação pedagógica. Eles são capazes de operar de forma contínua e adaptativa com base em comandos pré-definidos e lógica contextual.

Exemplos de uso:

- Agente tutor para responder dúvidas de alunos via WhatsApp ou Plurall;

- Agente avaliador para gerar relatórios por aluno com base em desempenho nas plataformas educacionais;

- Agente de conteúdo que gera material novo toda semana com base no currículo da escola.

Saiba mais na Formação Gestor de Agentes IA da No Code Start Up

Ferramentas de IA que todo educador precisa conhecer

Curipod

O Curipod é uma plataforma que permite a criação de aulas interativas em poucos minutos com suporte de IA. Professores podem inserir um tópico e receber automaticamente uma estrutura de aula com textos, quizzes, enquetes, imagens e outras atividades. É ideal para quem busca dinamismo e interações mais engajadoras em sala de aula.

Canva Magic Write

Integrado ao Canva, o Magic Write é um gerador de conteúdo com IA que ajuda educadores a criar slides, apresentações, resumos e materiais visuais em tempo recorde. Basta inserir uma ideia ou tema, e a ferramenta sugere textos coesos, visualmente prontos para o uso educacional.

AudioPen

AudioPen transforma a fala em texto automaticamente, sendo ideal para educadores que preferem ditar ideias ao invés de digitar. Pode ser usado para elaborar planos de aula, roteiros de vídeo, conteúdos de blog pedagógico e muito mais. É simples, prático e rápido.

Eduaide.Ai

Essa ferramenta oferece mais de 100 recursos para criação de conteúdo pedagógico de alta qualidade. Desde planos de aula completos, sugestões de estudos, feedbacks personalizados até indicações de metodologias ativas — tudo gerado com IA e disponível em vários idiomas. Conheça a Eduardo.AI

MagicSchool.ai

Plataforma voltada exclusivamente para educadores, o MagicSchool.ai centraliza geração de planos de aula, relatórios de desempenho, quizzes e conteúdos diversos. Um verdadeiro painel tudo-em-um para quem quer elevar a produtividade na gestão pedagógica.

Copilot for Education (Microsoft)

O Copilot integra-se ao Microsoft 365, permitindo que professores automatizem a criação de conteúdos e tarefas administrativas. Desde responder e-mails até montar apresentações com IA, ele é um aliado poderoso para otimizar tempo dentro e fora da sala de aula.

Dify + OpenAI

Ideal para quem quer personalizar seus próprios agentes educacionais. Com Dify, você conecta modelos da OpenAI em fluxos de trabalho práticos — como um agente para revisar redações, outro para corrigir provas ou até um bot de atendimento aos pais dos alunos.

Leia também: Curso FlutterFlow para Apps Educacionais

Automatização de tarefas pedagógicas: mais tempo para ensinar

Tarefas como emissão de feedback, organização de dados, envio de notificações e até correção de provas podem ser automatizadas. Isso permite que o professor foque em interações humanas, criatividade e acompanhamento próximo dos alunos.

Soluções como o Curso Make (Integromat) e Curso Xano podem ser integradas com plataformas de ensino para facilitar esses processos.

Perguntas Frequentes sobre IA para Educadores

Qual o melhor IA para professores?

Não existe uma única resposta, pois depende do objetivo. Para criação de conteúdo, o ChatGPT e o Eduaide.Ai se destacam. Para planejamento de aulas, o Curipod oferece estrutura pronta.

Para avaliação, Gradescope e MagicSchool.ai são boas escolhas. O ideal é combinar ferramentas conforme a necessidade pedagógica.

Quais são os tipos de IA usados na educação?

Os principais tipos são:

- IA generativa (como ChatGPT e Dify), usada para criar textos, atividades e até vídeos;

- IA analítica, que interpreta dados de desempenho e comportamento dos alunos;

- Agentes autônomos, que executam tarefas educativas sem supervisão constante, como correção de provas ou envio de feedbacks.

Qual o melhor site de IA para professores?

Plataformas como MagicSchool.ai, Eduaide.Ai e Canva Magic Write oferecem soluções robustas para professores. No ecossistema brasileiro, a No Code Start Up se destaca com formações práticas voltadas para IA aplicada à educação.

Como a IA pode ajudar professores?

Ela ajuda ao automatizar tarefas repetitivas, criar conteúdos personalizados, oferecer análise de dados em tempo real e permitir uma gestão mais eficiente da sala de aula. Isso libera tempo e amplia a qualidade do ensino de forma significativa.

IA para Educadores é um Caminho Sem Volta – E Você Precisa Estar Preparado

A IA na educação é mais do que uma tendência — é uma realidade transformadora. Educadores que aprendem a integrar essas tecnologias ao seu dia a dia ganham tempo, ampliam o impacto do seu trabalho e elevam a qualidade do ensino.