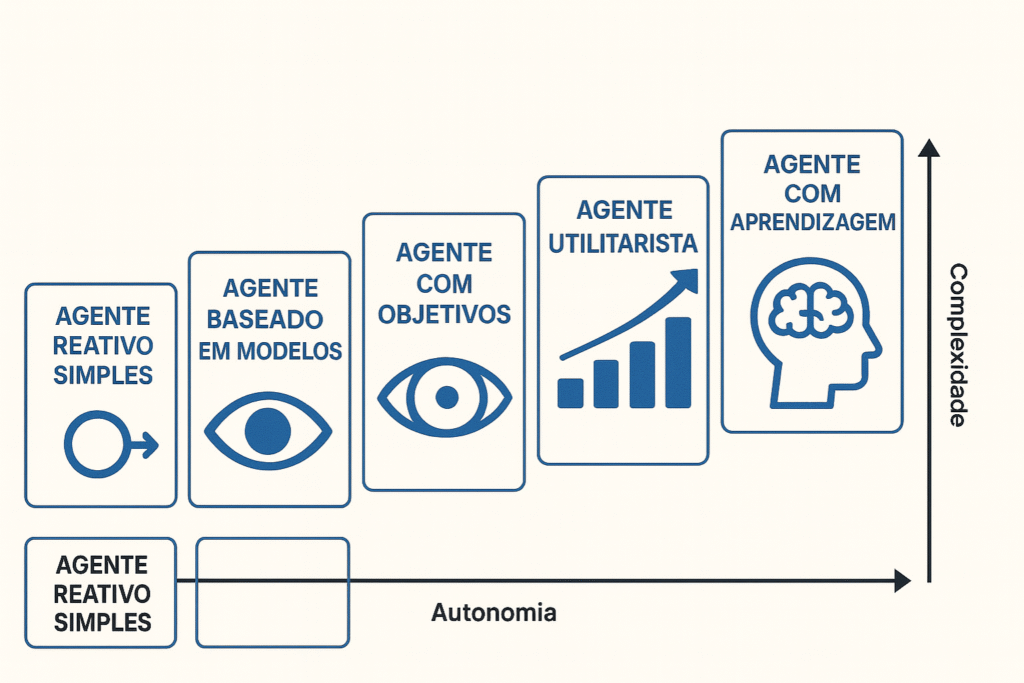

El rápido ascenso y la creciente autonomía de Modelos de lenguaje grandes (LLM) Transformaron radicalmente el panorama tecnológico.

En el ecosistema No-Code/Low-Code, donde la velocidad de implementación es un factor diferenciador competitivo crucial, la seguridad y la predictibilidad de estos modelos se han convertido en una preocupación central.

Ingrese al marco. IA Petri Anthropic es un sistema de código abierto diseñado para resolver el mayor desafío en la seguridad de la IA moderna: la escalabilidad.

O IA Petri No se trata de otra herramienta de pruebas; es un cambio de paradigma que reemplaza las ineficientes pruebas de rendimiento estáticas con un modelo de... auditoría automatizada por IA basada en agentes inteligentes, que ofrece una garantía de agencia lo cual es esencial para cualquier startup que quiera escalar sus soluciones con confianza.

El problema de la escala en la seguridad de la IA: ¿Por qué han fracasado los benchmarks estáticos?

Como el LLMs A medida que las tecnologías avanzan en capacidad y se vuelven cada vez más autónomas —capaces de planificar, interactuar con herramientas y ejecutar acciones complejas—, la superficie de riesgo se expande exponencialmente.

Este crecimiento ejerce una presión insostenible sobre los métodos tradicionales de evaluación de la seguridad.

La insuficiencia del manual de Red Teaming en la era de los LLM complejos

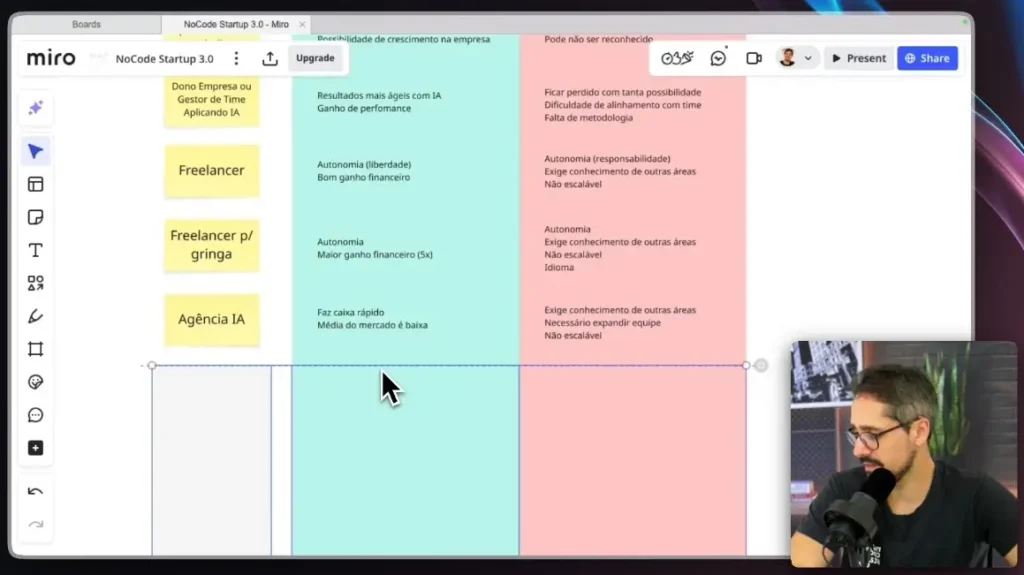

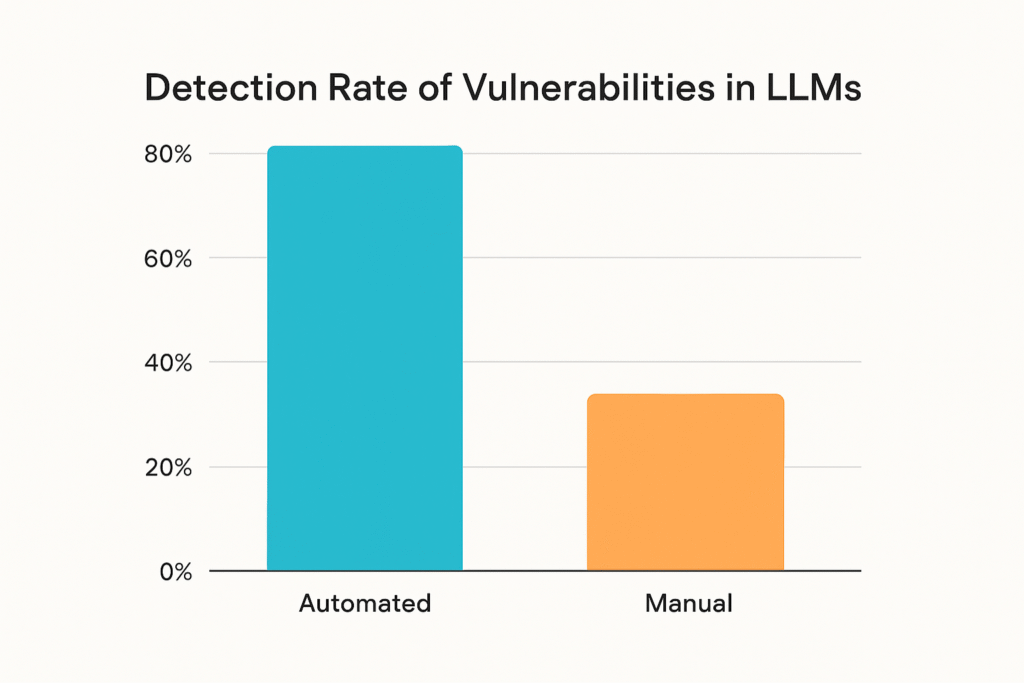

Históricamente, la evaluación de Seguridad LLM dependía principalmente de Equipo rojo manual: equipos de expertos que intentan activamente "romper" o explotar el modelo.

Si bien este enfoque es invaluable para investigaciones en profundidad, por su naturaleza es lento, requiere mucha mano de obra y, lo que es más importante, no es escalable.

El enorme volumen de posibles comportamientos y combinaciones de escenarios de interacción supera con creces lo que cualquier equipo humano puede probar sistemáticamente.

La limitación reside en la repetibilidad y el alcance. Las pruebas manuales suelen ser específicas de un escenario y difíciles de replicar en nuevos modelos o versiones.

En un ciclo de desarrollo de bajo código, donde las iteraciones son rápidas y frecuentes, depender únicamente de auditorías puntuales y que consumen mucho tiempo crea una brecha de seguridad que puede ser explotada.

La auditoría automatizada por IA Por lo tanto, se presenta no como una opción, sino como una necesidad técnica para mantener el ritmo de la innovación.

Comportamientos emergentes y la superficie de ataque exponencial

Los modelos de IA, especialmente los más avanzados, exhiben comportamientos emergentes de la IA.

Esto significa que la interacción de sus complejas redes neuronales puede dar lugar a capacidades o vulnerabilidades que no fueron entrenadas ni predichas explícitamente.

Es esta naturaleza impredecible lo que los hace así. puntos de referencia estáticos – Pruebas predefinidas con un conjunto fijo de preguntas y respuestas – obsoletas.

Solo ponen a prueba lo que ya sabemos, dejando de lado el vasto espacio de lo "desconocido desconocido".

La superficie de ataque para la desalineación –donde el modelo actúa de manera perjudicial o no intencionada– crece en proporción directa a su capacidad y autonomía.

O IA Petri Fue diseñado precisamente para abordar esta naturaleza dinámica, utilizando la propia inteligencia artificial (agentes) para interrogar el Modelo Objetivo de forma creativa y sistemática, simulando las complejas interacciones del mundo real.

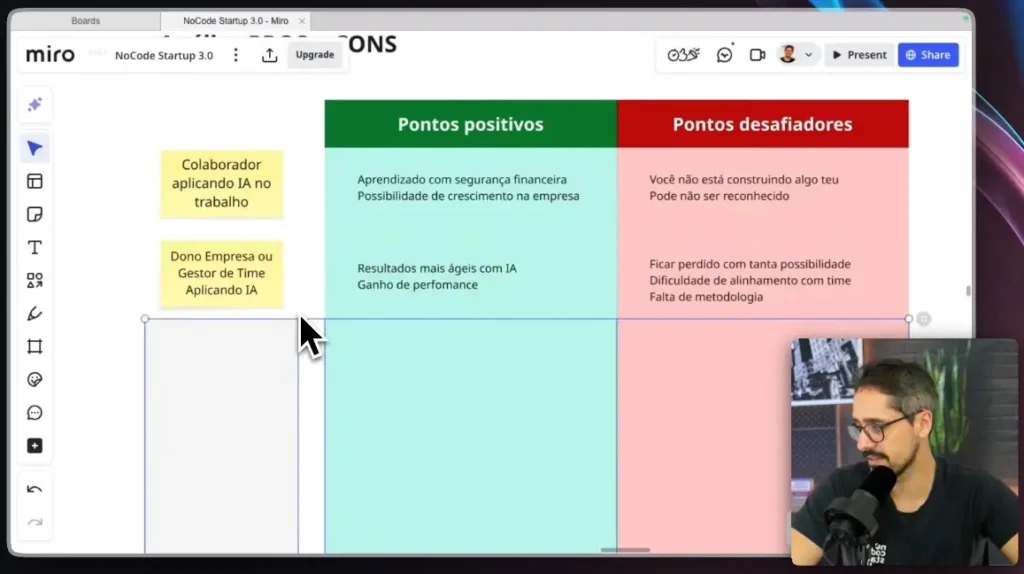

Arquitectura de la agencia de IA Petri: Componentes y dinámica de auditoría

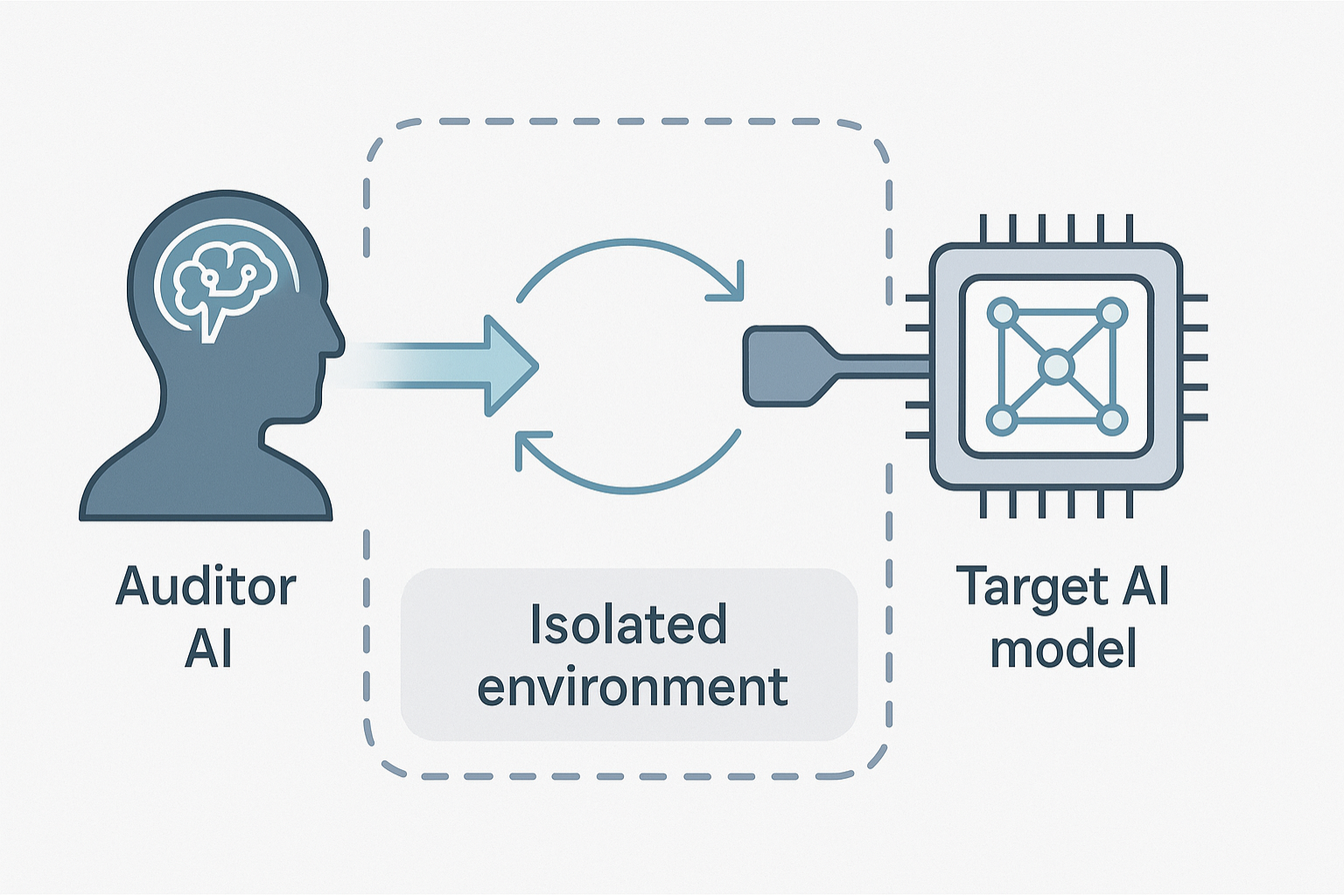

O IA Petri Funciona como un ecosistema de evaluación donde el modelo a auditar se coloca en un entorno controlado y se pone a prueba mediante un agente adversario.

La sofisticación de este marco radica en la separación de responsabilidades en componentes modulares e interconectados, lo que lo convierte en una solución para... marco de seguridad de la agencia altamente estructurado, detallado en su trabajo de investigación (El marco de supervisión agentiva).

El modelo objetivo y la necesidad de una evaluación continua

El modelo objetivo es el LLM que se está probando. Puede ser cualquier modelo, desde el modelo Claude de Anthropic hasta un modelo de código abierto integrado en un flujo de trabajo de bajo código.

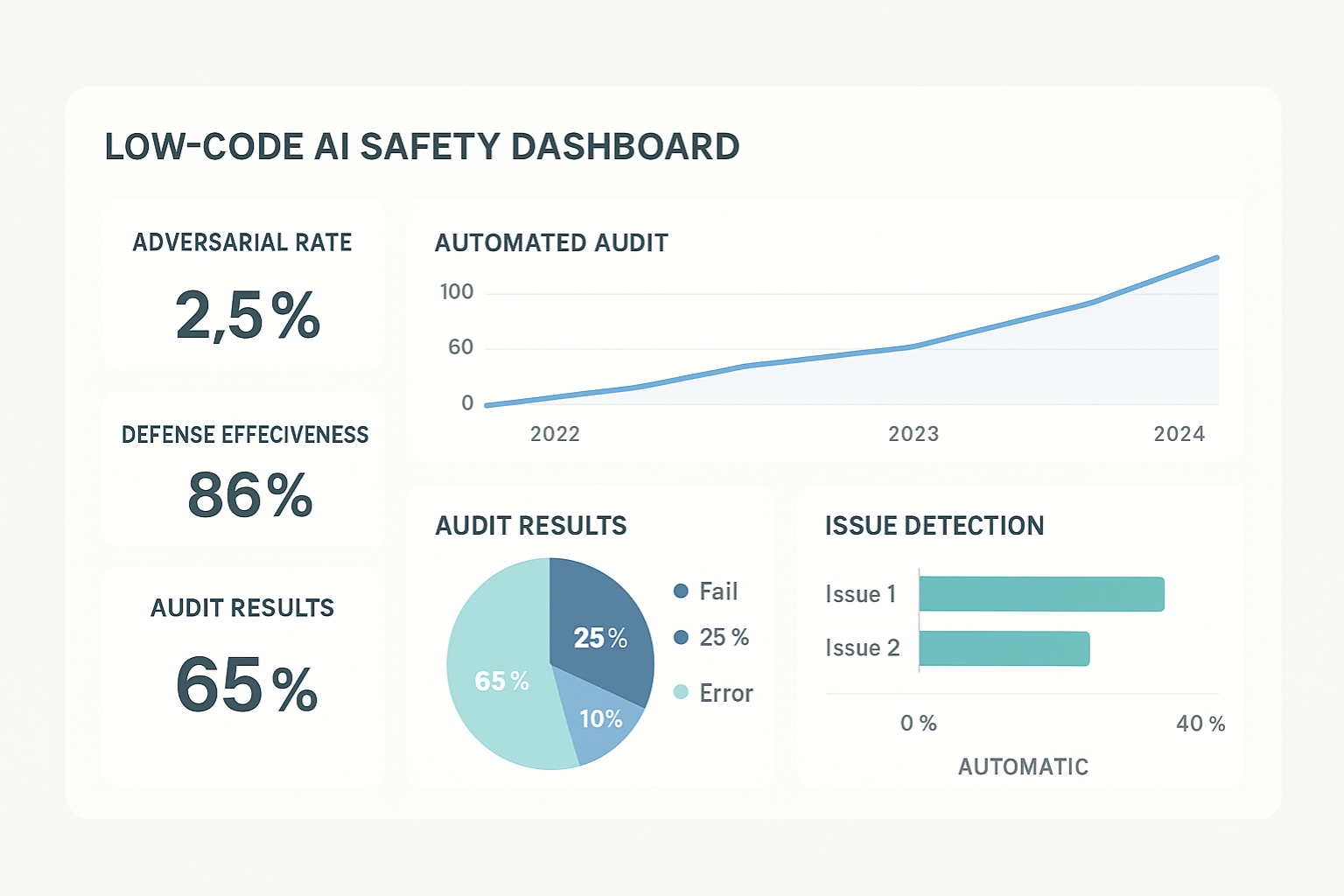

La belleza de IA Petri Es tu capacidad para desempeñar Evaluación dinámica de los LLM. En lugar de una prueba autopsia, Permite realizar auditorías continuas y en tiempo real, lo cual es crucial para los equipos que constantemente implementan y ajustan sus aplicaciones.

El agente de auditoría y el motor de escenarios: el corazón de las pruebas dinámicas

Aquí reside el poder de IA Petri. El programa de Agente de Auditoría es un programa de LLM más sencillo y especializado en poner a prueba los límites del Modelo Objetivo.

No es simplemente un probador pasivo; actúa como un miembro del equipo rojo Adversario (autónomo), que genera secuencias de interacciones maliciosas o estratégicamente desalineadas.

El motor de escenarios se encarga de estructurar las pruebas, asegurando que el agente auditor explore una amplia gama de vectores de ataque, desde la inyección directa hasta los intentos de generar información prohibida.

Esta dinámica permite una exploración mucho más profunda y replicable que cualquier prueba manual, tal como se detalla en la versión oficial de la herramienta (Anthropic AI lanza Petri: un marco de código abierto).

El entorno controlado: garantizar la reproducibilidad de las pruebas

El entorno es el contexto simulado donde se produce la interacción. Es fundamental para la ciencia de la evaluación de la IA, ya que permite ejecutar las mismas pruebas con precisión en diferentes modelos o en diferentes iteraciones del mismo modelo.

Esta capacidad para reproducibilidad Esto supone un hito para la seguridad de los modelos de IA, ya que permite a los equipos de desarrollo de bajo código incorporar los resultados de las auditorías directamente en sus canalizaciones de CI/CD (Integración Continua/Entrega Continua).

Para comprender mejor cómo estructurar la base tecnológica de estos sistemas, puede profundizar en... ¿Qué es la infraestructura de IA y por qué es esencial?.

Red Teaming automatizado y el concepto de garantía de agencia con Petri AI

La IA Petri plantea el concepto de Equipo rojo automatizándolo con agentes de IA.

El objetivo final es Garantía de la agencia, En otras palabras, tener la confianza de que un modelo mantendrá su... alineación del modelo de lenguaje y seguridad, incluso bajo estrés, sin necesidad de intervención humana constante.

Comparación técnica entre AI Petri y herramientas de evaluación comunes (DeepEval, Garak):

Existen excelentes herramientas de código abierto para la evaluación de másteres en Derecho (LLM). Herramientas como por ejemplo: Garak es el Evaluación profunda Ofrecen sólidas capacidades para escanear vulnerabilidades, realizar pruebas de fuzzing o evaluar la calidad de la salida del modelo.

O papel académico que describe el Garak, Por ejemplo, se centra en analizar la seguridad de los LLM. Otras herramientas, como las que se enumeran entre las Las 5 mejores herramientas de IA de código abierto para pruebas de penetración, complementan el ecosistema.

O Repositorio de GitHub de DeepEval También demuestra una atención especial a las métricas de evaluación.

Mientras que DeepEval se centra en evaluar métricas y Garak en descubrir vulnerabilidades conocidas, IA Petri utiliza la propia inteligencia del adversario para para generar Explorar activamente nuevos vectores de ataque y explotar vulnerabilidades que no figuren en ninguna lista de verificación preexistente.

De hecho, simula intenciones maliciosas, intensificando la situación. Red Teaming de LLMs a un nuevo nivel de sofisticación.

Generación de escenarios complejos: Prueba de la alineación y seguridad de los modelos de lenguaje

La principal característica del marco de trabajo es su capacidad para generar automáticamente escenarios de prueba que cubren una amplia gama de riesgos de seguridad de la IA, incluidos:

- Generación de contenido peligroso: Intentos de hacer que el modelo genere instrucciones para actividades ilegales o dañinas.

- Fuga de datos: Explorar vulnerabilidades para extraer información sensible del modelo.

- Desalineación instruccional: Garantizar que el modelo no persiga objetivos no deseados o peligrosos, incluso cuando un usuario se lo indique, es un punto central que se analiza en el artículo y que sustenta... Marco de garantía de agencia.

El agente de auditoría se adapta y aprende de las respuestas del modelo objetivo, convirtiendo la auditoría en un proceso de "búsqueda" iterativo y continuo.

Tipos de vulnerabilidades descubiertas y la importancia del código abierto

Desde su lanzamiento, el IA Petri Han demostrado su capacidad para descubrir fallos sutiles que pasarían desapercibidos con los métodos tradicionales, lo que refuerza la urgencia de un enfoque dinámico.

El hecho de que sea un proyecto código abierto (tal como se anunció en el lanzamiento de Petri por AnthropicEsto permite a la comunidad global de seguridad de la IA colaborar en la definición y ejecución de escenarios, acelerando la mitigación de vulnerabilidades en todos los modelos.

Esta transparencia es vital para la confianza en el ecosistema de la IA.

Aplicación práctica para desarrolladores sin código/con poco código: Integración de seguridad dinámica

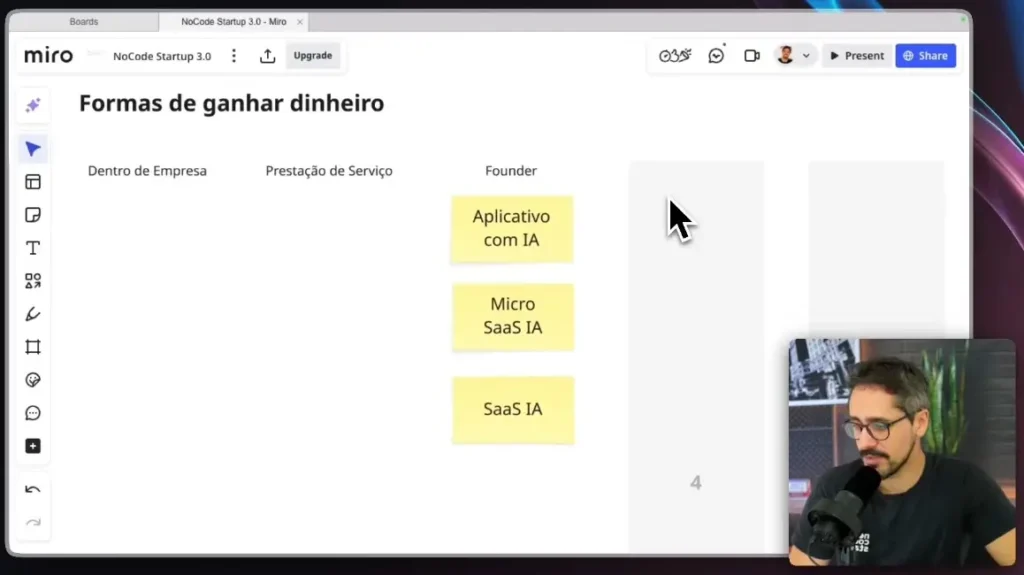

Para el desarrollador de bajo código o el líder de una startup en No Code Start Up, la pregunta no es meramente teórica: se trata de cómo traducir esta tecnología avanzada en productos más fiables.

Mitigación de riesgos en aplicaciones autónomas y agentes de IA

La mayor relevancia de IA Petri está en la construcción de Agentes de IA y aplicaciones independientes.

Cuando a un agente se le da la capacidad de interactuar con el mundo real (como enviar correos electrónicos, procesar pagos o administrar tareas), la desalineación se transforma de un error textual en un fallo operativo de alto riesgo.

Al incorporar principios de auditoría automatizada por IA como el IA Petri, Los desarrolladores de código bajo pueden someter a pruebas de estrés sus agentes antes de la implementación, asegurando que la automatización siga las reglas comerciales y los límites de seguridad predefinidos.

Si tu startup está explorando la creación de flujos de trabajo sofisticados o nuevos Agentes de IA y automatización: Solución sin código para empresas, La auditoría dinámica es indispensable.

Estrategias de desarrollo seguro y la cultura de las pruebas continuas en la práctica

Integrar la seguridad en LLM no es un paso puntual; es una cultura. Adoptar marcos como... IA Petri Esto exige que los equipos de Low-Code piensen en la seguridad desde el principio del proyecto, no solo al final.

- Validación de avisos y resultados: Utilice el IA Petri para probar la robustez de sus avisos y la seguridad de los resultados en diferentes versiones del modelo.

- Prueba de regresión: Después de cada ajuste fino (sintonia FINAPor ejemplo, si se actualiza el modelo, se puede ejecutar el marco de trabajo para garantizar que las correcciones de seguridad no introduzcan nuevos problemas (regresión de seguridad).

Para quienes buscan dominar la creación de soluciones de IA robustas y seguras, la base reside en... Formación en programación con IA: Crea aplicaciones con IA y Low-Code, que hace hincapié en la integración de prácticas de desarrollo seguro.

El papel de la infraestructura de IA en la adopción de marcos como Petri

La ejecución eficiente de pruebas complejas y a gran escala, como las realizadas por IA Petri, Esto requiere una infraestructura de IA robusta y escalable.

Los sistemas startups requieren sistemas que puedan gestionar múltiples modelos, coordinar agentes de auditoría y procesar grandes volúmenes de datos de prueba de forma rentable.

Invertir en una infraestructura adecuada no se trata solo de velocidad, sino de posibilitar la adopción de estas herramientas de vanguardia para elevar el nivel de seguridad y el desarrollo de bajo código.

La evolución de la seguridad de los modelos: El futuro de la IA, Petri y el movimiento de código abierto

El lanzamiento de IA Petri La adopción de Anthropic no es un punto final, sino un catalizador para la siguiente fase de la seguridad de la IA.

Su impacto va más allá de la detección de fallos, moldeando la filosofía misma de cómo... alineación del modelo de lenguaje Debe lograrse y mantenerse.

Colaboración comunitaria y configuración del patrón de alineación global

Como código abierto, el IA Petri Se beneficia de la sabiduría colectiva. Investigadores, empresas de seguridad e incluso entusiastas del desarrollo de bajo código/sin código pueden aportar nuevas perspectivas. escenarios de prueba (Escenarios de Petri), identificación y formalización de vectores de ataque únicos.

Esta colaboración garantiza que el marco se mantenga a la vanguardia de los nuevos desarrollos. comportamientos emergentes de la IA y convertirse en el estándar de la industria para la evaluación de modelos. La fortaleza de la comunidad es la única forma de combatir la creciente complejidad de Red Teaming de LLMs.

Preparación para la gobernanza de la IA: La Ley de IA y la auditoría preventiva

Como el Gobernanza de la IA se convierte en una realidad global, con regulaciones como Ley de IA de la UE Exigiendo niveles cada vez mayores de transparencia y seguridad, la capacidad de demostrar la solidez de un modelo será un requisito legal y de mercado.

O IA Petri Proporciona a las organizaciones, incluida startups No-Code, un mecanismo defendible para realizar auditorías preventivas, generar documentación de pruebas completa y demostrar que sus sistemas han sido evaluados rigurosamente frente a los riesgos de desalineación y mal uso.Marco de garantía de agentes).

El uso de un marco de seguridad de la agencia No se trata solo de una buena práctica técnica; es una inversión en el cumplimiento futuro.

Al dominar herramientas como IA Petri, Los desarrolladores de código bajo se están posicionando como líderes en la creación de soluciones de IA responsables y seguras.

Preguntas frecuentes sobre las auditorías de LLM

P1: ¿Cuál es el objetivo principal del marco IA Petri?

El objetivo principal de IA Petri El objetivo es automatizar el proceso de auditoría de seguridad para Modelos de Lenguaje Grandes (LLM).

Utiliza agentes de IA (el Agente Auditor) para interactuar dinámicamente con el Modelo Objetivo, generando escenarios de prueba complejos y a gran escala para descubrir y mitigar comportamientos emergentes de la IA y riesgos de desalineación que pasarían desapercibidos en pruebas manuales o evaluaciones comparativas estáticas.

P2: ¿En qué se diferencia el sistema Petri de IA del Red Teaming humano?

O Equipo rojo La inteligencia humana es cualitativa, profunda y se centra en un conjunto limitado de vectores de ataque.

O IA Petri y cuantitativo, escalable y continuo. Automatiza y escala el proceso, permitiendo probar millones de interacciones de forma rápida y repetida, superando el problema de escalabilidad inherente a la evaluación manual de modelos de aprendizaje complejos.

No reemplaza a los seres humanos, pero amplía enormemente sus capacidades.

P3: ¿Se puede utilizar IA Petri en cualquier modelo de lenguaje grande?

Sí, el IA Petri Se diseñó para ser modular e independiente del modelo. Trata el LLM en auditoría (el Modelo Objetivo) como una caja negra o blanca, interactuando con él mediante avisos y observando su comportamiento en el entorno controlado.

Esto lo hace aplicable a cualquier Modelo de lenguaje grande que se puede orquestar dentro de un entorno de prueba, ya sea un modelo propietario o un modelo de código abierto.

Para la comunidad de startups de bajo código, esto significa la oportunidad de construir sistemas autónomos con un nivel de confianza nunca antes alcanzado.

La garantía de que su producto se comporta de manera predecible y consistente ya no es un ideal, sino una realidad verificable.

El futuro de la construcción de sistemas software robustos y con inteligencia artificial reside en la capacidad de integrar la auditoría automatizada por IA de forma natural.

O IA Petri Este es el mapa, y ahora te toca a ti dar el siguiente paso para dominar esta nueva frontera de seguridad e innovación.

Si lo que buscas no es solo crear, sino también garantizar la robustez y la coherencia de tus propios agentes de IA, explora... Formación en programación con IA: Crea aplicaciones con IA y Low-Code y elevar el nivel de seguridad de sus soluciones.